Риски корпоративного ИИ: альтернативы OpenAI и институты, стоящие за агентами ИИ

Пробелы в конфиденциальности данных, соответствии требованиям и доверии в текущих интеграциях агентов ИИ

«Подождите... вы отправляете записи своей бухгалтерской книги в OpenAI?»

Это было первое, о чем спросила меня моя подруга, когда я ей это показала. Почувствуй-Пиши, приложение для ведения дневника на базе искусственного интеллекта, которое я создал во время хакатона в Сан-Франциско.

Я пожал плечами.

«Это был хакатон, посвященный искусственному интеллекту, и мне нужно было что-то быстро создать».

Она не упустила ни одного момента:

«Конечно. Но как я могу доверять тому, что я создал? Почему бы не организовать собственную LLM?»

Это меня остановило.

Я был горд тем, как быстро было создано приложение. Но этот вопрос и последующие раскрыли все, что я, как мне казалось, знал об ответственном строительстве с использованием ИИ. Об этом также упомянули судьи хакатона.

В этот момент я осознал, насколько неуважительно мы относимся к разработке с использованием ИИ, особенно инструментов, обрабатывающих конфиденциальные данные.

Я понял нечто большее:

Мы недостаточно говорим о доверии при разработке проектов с использованием ИИ.

Ее ответ запал мне в душу. Джорджия фон Минден — специалист по анализу данных в Американском союзе защиты гражданских свобод (ACLU), где она тесно сотрудничает с вопросами, связанными с персональными данными в контексте юридических и гражданских прав. Я всегда ценил ее проницательность, но этот разговор был другим.

Поэтому я попросил ее объяснить. Что на самом деле означает доверие в этом контексте? Особенно когда системы ИИ имеют дело с персональными данными.

Она сказала мне:

«Доверие может быть трудно установить, но управление данными — хорошая отправная точка. Кто владеет данными, как они хранятся и для чего используются — все это важно. Десять лет назад я бы ответил на этот вопрос по-другому. Но сегодня, с огромной вычислительной мощностью и огромными хранилищами данных, широкий вывод — это реальная проблема. OpenAI имеет такой обширный доступ как к вычислениям, так и к данным, что его отсутствие прозрачности заставляет проявить осторожность».

«Когда речь идет о персонально идентифицируемой информации (PII), и правила, и здравый смысл указывают на необходимость строгого управления данными. Отправка персонально идентифицируемой информации в вызовах API не просто рискованна — она также может нарушить эти правила и подвергнуть людей опасности».

Это напомнило мне, что когда мы создаем системы с использованием ИИ, особенно те, которые обрабатывают конфиденциальные человеческие данные, мы не просто пишем код.

Мы принимаем решения относительно конфиденциальности, полномочий и доверия.

В тот момент, когда вы собираете пользовательские данные, особенно что-то личное, например, записи в журнале, вы вступаете в зону ответственности. Дело не только в том, что может сделать ваша модель. Речь идет о том, что происходит с этими данными, куда они попадают и кто имеет к ним доступ. Ответственное управление пользовательскими данными повышает доверие пользователей и улучшает конфиденциальность.

Иллюзия простоты

Сегодня проще, чем когда-либо, выпустить на рынок что-то, что выглядит умным. Благодаря крупным языковым моделям (LLM), таким как OpenAI и другим, разработчики могут создавать инструменты ИИ за считанные часы. Стартапы могут запускать функции на базе искусственного интеллекта в одночасье. А как насчет институтов? Компания спешит интегрировать этих агентов в свой рабочий процесс.

Но во всем этом волнении часто упускается из виду одна вещь: уверенность.

Когда люди говорят о Агенты ИИОни часто ссылаются на простые оболочки вокруг больших языковых моделей (LLM). Эти агенты могут отвечать на вопросы, автоматизировать задачи или даже принимать решения. Однако многие из них строятся в спешке, без должного внимания к безопасности, соблюдению требований и подотчетности.

Просто используйте продукт для OpenAI Это не значит, что это безопасно. Чему вы действительно доверяете, так это всему конвейеру:

- Кто построил обложку?

- Как обрабатываются ваши данные?

- Хранится ли, записывается ли или, что еще хуже, происходит ли утечка вашей информации?

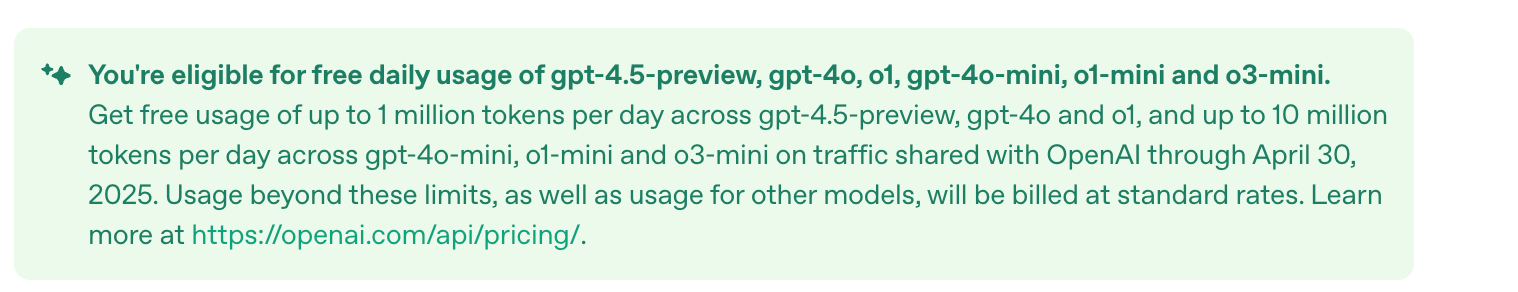

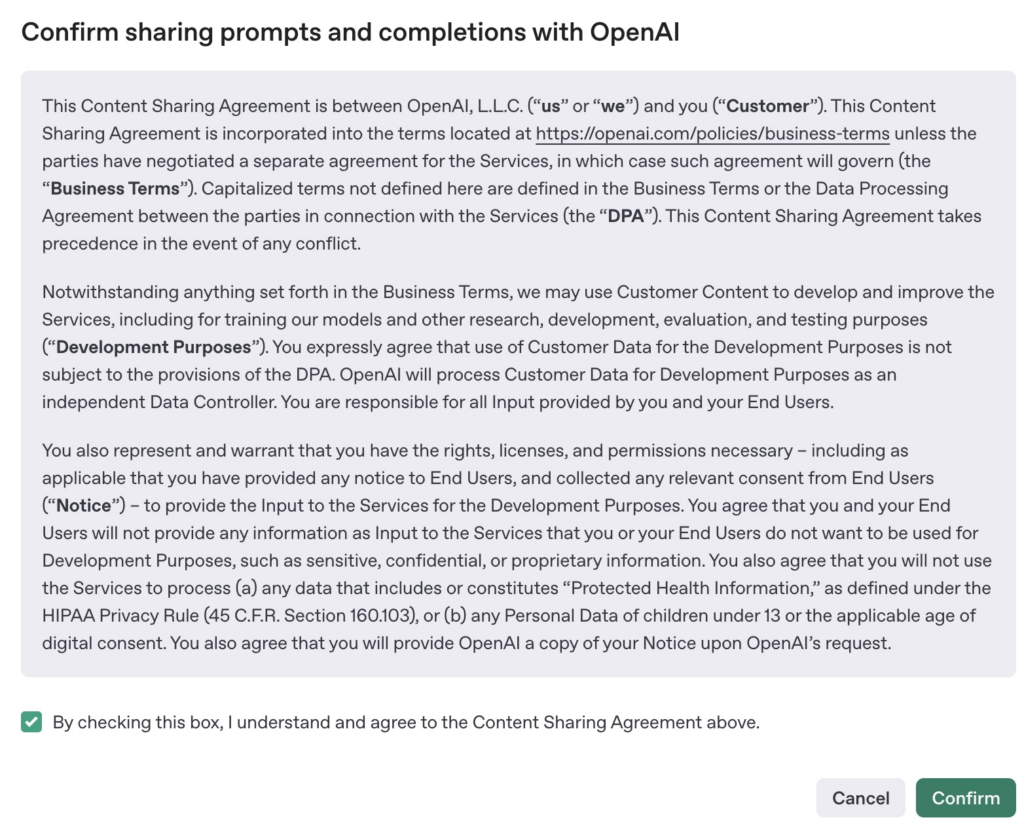

Я сам использую API OpenAI для клиентских задач. Недавно мне предложили бесплатный доступ к API — до 1 миллиона токенов в день до конца апреля — Если я согласен поделиться данными о моих претензиях.

Я почти согласился на это ради личного стороннего проекта, но потом мне пришло в голову: если бы поставщик решений пошел на такую же сделку, чтобы сократить расходы, его пользователи даже не подозревали бы, что их данные передаются. На личном уровне это может показаться безобидным. Но в контексте учреждения? Это серьезное нарушение конфиденциальности и, возможно, договорных или нормативных обязательств.

Достаточно, чтобы один инженер сказал «да» такой сделке, и данные ваших клиентов окажутся в чьих-то руках.

Корпоративный ИИ повышает ожидания

Я вижу, что всё больше SaaS-компаний и стартапов, занимающихся разработкой инструментов, экспериментируют с ИИ-агентами. Некоторые из них демонстрируют хорошие результаты, например, некоторые ИИ-агенты позволяют пользователям создавать собственные большие языковые модели (LLM), давая им контроль над тем, где модель будет запущена и как будут обрабатываться данные. Это разумный подход, особенно учитывая растущую роль ИИ в корпоративной среде.

Вот вдумчивый подход: Вы устанавливаете пределы доверия..

Но не все так заинтересованы.

Многие компании просто подключаются к API OpenAI, добавляют несколько кнопок и называют это «готовым к использованию на предприятии».

Предупреждение: это неправда.

Что может пойти не так? много.

Если вы интегрируете агентов ИИ в свою инфраструктуру, не задавая сложных вопросов, вот потенциальные риски:

- Утечка данныхВаши заявления могут включать конфиденциальные данные клиентов, ключи API или внутреннюю логику — и если они отправлены в стороннюю форму, они могут быть раскрыты.

В 2023 году инженеры Samsung непреднамеренно вставили внутренний исходный код и заметки в ChatGPT (Forbes). Эти данные теперь могут стать частью будущих обучающих наборов, что представляет собой значительный риск для интеллектуальной собственности.

- Нарушения соответствияОтправка персонально идентифицируемой информации (PII) через такую форму, как OpenAI, без соответствующего контроля может стать нарушением Общего регламента по защите данных (GDPR), HIPAA или ваших контрактов.

Компания Илона Маска X усвоила это на собственном горьком опыте. Они запустили своего чат-бота на основе искусственного интеллекта «Grok», используя для его обучения все сообщения пользователей, в том числе из ЕС, без соответствующей подписки. Организаторы быстро вмешались. Под давлением они прекратили тренировать Грока в Европейском Союзе (Politico).

- неопределенное поведениеНедетерминированные агенты трудно поддаются исправлению или объяснению. Что происходит, когда клиент спрашивает, почему чат-бот дал неверную рекомендацию или раскрыл что-то конфиденциальное? Чтобы ответить на этот вопрос, нужна прозрачность, а многие агенты сегодня ее не обеспечивают.

- Путаница в отношении права собственности на данныеКому принадлежит продукт? Кто регистрирует данные? Проводит ли поставщик услуг переподготовку на основе ваших данных?

Именно на этом и поймали Zoom в 2023 году. Они тихо изменили условия обслуживания, чтобы разрешить использовать данные встреч с клиентами для обучения ИИ (Fast Company). После негативной реакции общественности они пересмотрели политику, но это послужило напоминанием о том, что доверие можно потерять в одночасье.

- Недостатки безопасности в упаковкеВ 2024 году десятки развертываний Flowise — популярного инструмента оркестровки LLM с низким кодом — были обнаружены в Интернете, многие из которых не имели аутентификации (Новости кибербезопасности). Исследователи обнаружили в открытом доступе ключи API, учетные данные базы данных и пользовательские данные. Это не проблема OpenAI — это проблема. Строители. Однако конечные пользователи все равно платят цену.

- Возможности ИИ, которые заходят слишком далекоФункция «Recall» от Microsoft, являющаяся частью их развертывания Copilot, автоматически делает снимки экрана действий пользователей, чтобы помочь помощнику на основе искусственного интеллекта отвечать на вопросы (DoublePulsar). Это казалось полезным… пока эксперты по безопасности не указали на то, что это кошмар для конфиденциальности. Microsoft пришлось быстро отступить и сделать эту функцию только необязательной.

Не всем нужен OpenAI.

OpenAI — невероятно мощная платформа. Но это не всегда лучшее решение.

Иногда вполне достаточно локальной модели меньшего размера. В других случаях логика, основанная на правилах, справляется с этой задачей лучше. Самым безопасным вариантом часто является тот, который действует исключительно в рамках вашей собственной инфраструктуры и по вашим правилам.

Мы не должны просто слепо подключать большую языковую модель (LLM) и называть ее «интеллектуальным помощником».

В учреждениях, Доверие, прозрачность и контроль не являются дополнительными опциями. - Скорее, это необходимо.

Растет число платформ, позволяющих осуществлять такой тип контроля. Einstein 1 Studio от Salesforce теперь поддерживает эту функцию приведи-свою-модель, что позволяет вам подключить большую языковую модель (LLM) из AWS или Azure. IBM Watson позволяет организациям развертывать модели внутри компании с полным контролем событий. Благодаря MosaicML Databricks позволяет вам обучать частные большие языковые модели (LLM) в вашем собственном облаке, поэтому ваши конфиденциальные данные никогда не покидают вашу инфраструктуру.

Вот как должен выглядеть настоящий корпоративный ИИ.

Заключение

Агенты ИИ невероятно эффективны и обеспечивают такие рабочие процессы и автоматизацию, которых мы не могли достичь раньше. Однако простота разработки не обязательно означает безопасность, особенно при работе с конфиденциальными данными в больших масштабах.

Прежде чем начать использовать это блестящее новое средство, спросите себя:

- Кто контролирует модель?

- Куда попадают данные?

- Соблюдаем ли мы нормативные требования?

- Можем ли мы проверить, что он делает?

В эпоху искусственного интеллекта самая большая угроза — это не плохие технологии, а Слепое доверие.

Об авторе

Меня зовут Эллен, я инженер по машинному обучению с 6-летним опытом работы, в настоящее время работаю в финтех-стартапе в Сан-Франциско. Мой опыт охватывает должности в сфере науки о данных в консалтинговых компаниях нефтегазовой отрасли, а также руководство программами обучения в области искусственного интеллекта и данных в Азиатско-Тихоокеанском регионе, на Ближнем Востоке и в Европе.

В настоящее время я заканчиваю обучение по программе магистратуры по направлению «Наука о данных» (окончание обучения запланировано на май 2025 года) и активно ищу новую работу в качестве инженера по машинному обучению. Если вы открыты для рекомендации или связи, я буду вам очень признателен!

Мне нравится оказывать реальное влияние на мир с помощью ИИ, и я всегда открыт для сотрудничества в рамках проектов.

Комментарии закрыты.