Как установить новейшие модели обработки больших языков (LLM) локально на Mac

В последние годы большие языковые модели (LLM) приобретают все большую популярность благодаря своей способности генерировать текст, похожий на человеческий, и помогать в решении различных задач. Не все модели являются открытым исходным кодом, но почти каждая крупная технологическая компания имеет свою версию, которую пользователи могут загрузить и запустить.

Запуск этих моделей локально на вашем Mac может быть выгоден как с точки зрения конфиденциальности, так и с точки зрения экономии средств. В этой статье мы рассмотрим, как установить и запустить LLM-модели с помощью... ОлламаЭто мощный инструмент как для разработчиков, так и для начинающих пользователей, и мы обсудим некоторые графические средства пользовательского интерфейса, которые могут упростить процесс для тех, кто предпочитает не использовать терминал macOS.

Таким образом, вы можете получить доступ к новейшим текстовым шаблонам, созданным с помощью ИИ, от [Google], [Microsoft], [Meta] и других компаний, занимающихся ИИ, таких как [Mistral] и [DeepSeek].

Понимание линейных моделей поведения: что означают эти параметры?

Прежде чем приступить к процессу установки, давайте уточним, что означают такие цифры, как «7B"Или же"14BПрименительно к LLM эти числа обозначают размер модели в терминах учителя (В миллиардах), которые по сути являются «ручками и переключателями», точно настраиваемыми во время тренировки.

Большее количество параметров позволяет модели улавливать более сложные закономерности и взаимосвязи в языке, что потенциально приводит к повышению производительности. Однако важно отметить, что наличие большего количества параметров не всегда гарантирует лучшие результаты; качество обучающих данных и вычислительные ресурсы, доступные модели, также играют значительную роль.

Системные Требования

Вам необходимо убедиться, что ваш [Mac] соответствует как минимум следующим требованиям:

- macOS 10.15 или более поздняя версия (рекомендуется macOS 13 или более поздняя версия)

- Минимум 8 ГБ оперативной памяти (рекомендуется 16 ГБ или больше).

- 10 ГБ свободного места для хранения данных (минимальное требование для самых маленьких моделей; для более продвинутых моделей с максимальным количеством параметров требуется приблизительно 700 ГБ).

- Многоядерный процессор [Intel] или процессор [Apple Silicon] (предпочтительно M2 или выше)

Установить Олламу

Оллама Это инструмент с открытым исходным кодом, позволяющий запускать LLM-модели непосредственно на локальном компьютере. Вот как начать работу:

- Скачать Ollama: Посетите сайт Оллама Скачайте версию для macOS. Вы также можете установить её с помощью Homebrew, запустив команду...

brew install ollamaВ вашем терминале.

- Установить ОлламуЕсли вы скачали установщик, дважды щелкните по нему и следуйте инструкциям мастера установки. Если вы используете Homebrew, перейдите к шагу 4.

- Следующим шагом для установщика будет просто нажать кнопку. УстановкиДля этого потребуется ваш пароль администратора.

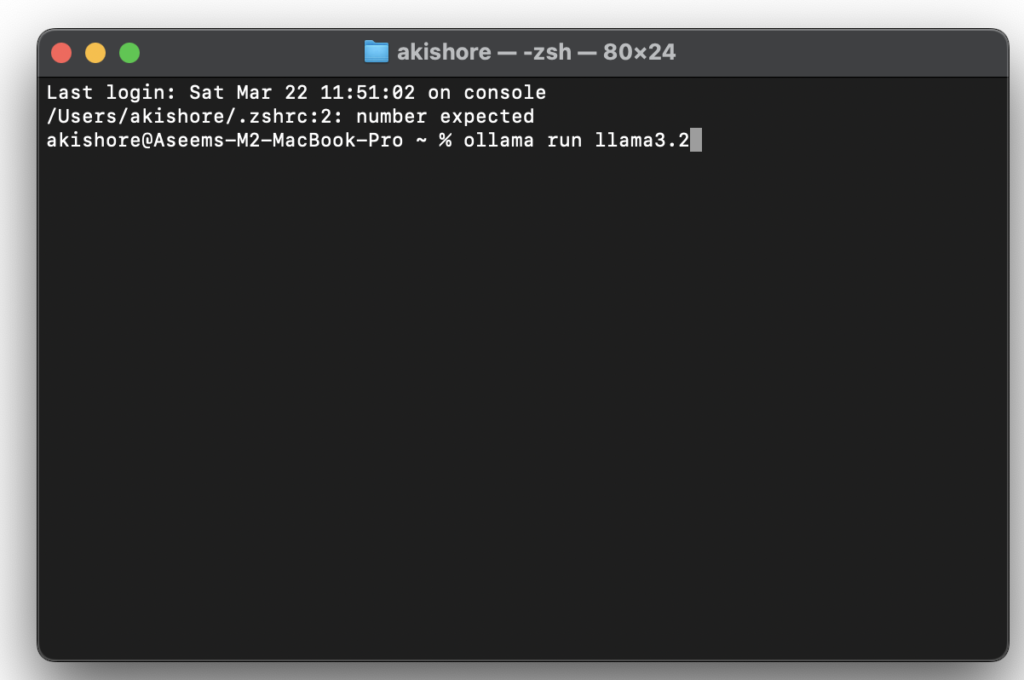

- Беги, ОлламаОткройте окно терминала и запустите Ollama как службу, используя команду.

brew services start ollamaЭто позволит получить доступ к Ollama по указанному адресу.http://localhost:11434/. - Скачайте и запустите модель.Используйте команду

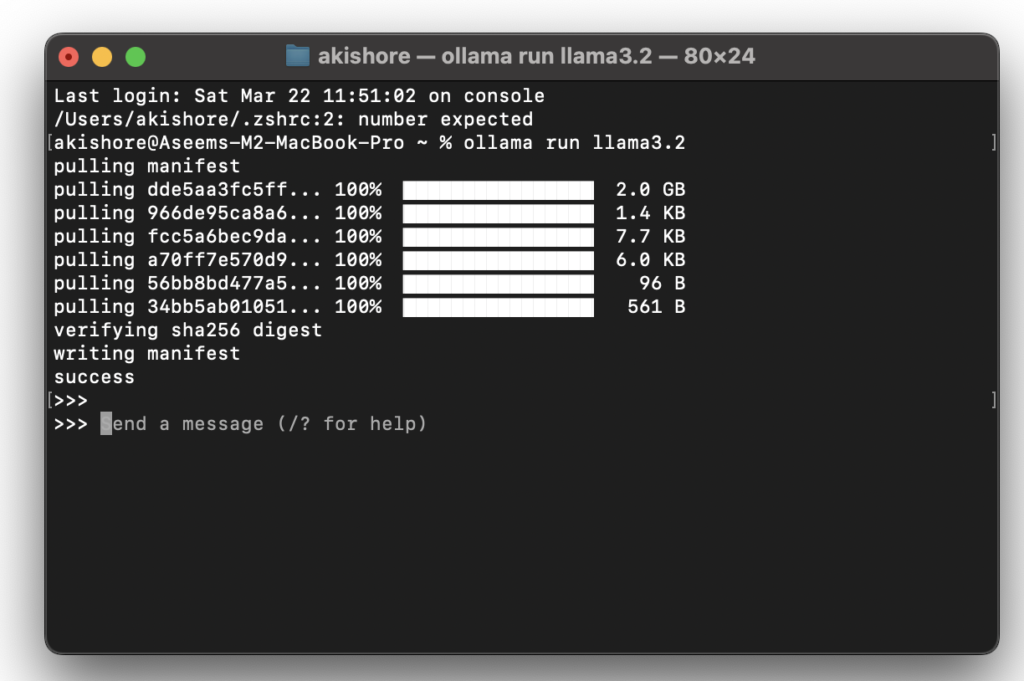

ollama pull <model-name>Чтобы загрузить шаблон, используйте команду.ollama run <model-name>Чтобы запустить его. Например, чтобы запустить модель. ДипСик-Р1, используйте командуollama pull deepseek-r1Затем последовал приказollama run deepseek-r1. - Чтобы загрузить увеличенную версию шаблона, просто добавьте две вертикальные точки, а затем размер. Например, чтобы загрузить шаблон 14B DeepSeekВы воспользуетесь командой оллама запустить deepseek-r1:14bНа сайте Ollama вы можете щелкнуть по любой из форм, и вам будут показаны все различные команды для каждой версии.

Полный список можно найти здесь. Модели Ollama Здесь. Вы также можете использовать вторую команду, как описано выше, и если она еще не установлена, она сначала загрузит форму, а затем выполнит ее.

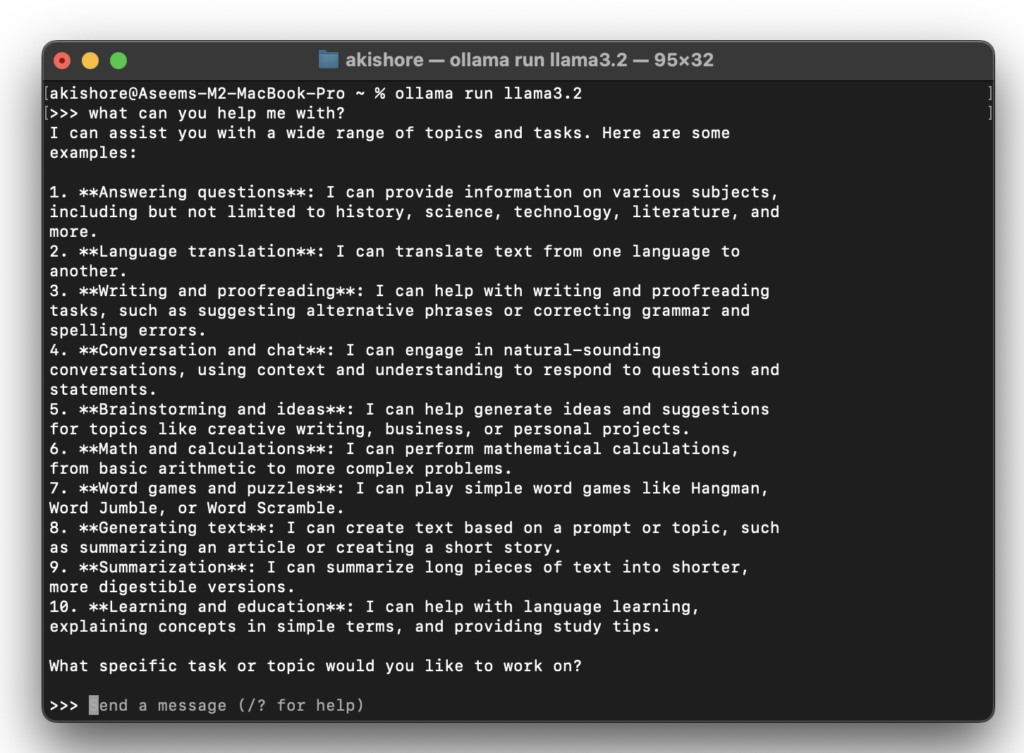

Теперь, когда вы видите три стрелки, направленные прямо (>>>), вы можете начать вводить команды в форму.

Вот и все! Теперь вы можете взаимодействовать со своим лектором по искусственному интеллекту локально, не беспокоясь о расходах, чрезмерном использовании ресурсов или о том, что кто-то сможет прочитать то, что вы пишете. Это отлично подходит, если у вас есть какие-то конфиденциальные или личные темы, которые вы хотели бы обсудить с лектором по искусственному интеллекту, но вы не хотите, чтобы крупная технологическая компания читала ваши мысли.

Использование инструментов графического пользовательского интерфейса с Ollama

Хотя Ollama — мощный и эффективный инструмент для разработчиков, некоторые пользователи могут предпочитать графический интерфейс пользователя (GUI) для взаимодействия с LLM. Вот несколько инструментов, которые могут обеспечить графический интерфейс для Ollama:

-

-

- Графический интерфейс ОлламаЭто бесплатное приложение с открытым исходным кодом для пользователей macOS, созданное с использованием SwiftUI. Оно предлагает красивый интерфейс и является отличным вариантом для тех, кто хочет получить доступ к формам LLM локально, без использования терминала.

- Ollama UIПростой веб-интерфейс на основе HTML, позволяющий создавать формы и взаимодействовать с ними непосредственно в браузере. Также включает расширение для Chrome для удобного доступа.

- Чатбокс ИИЭто самый простой вариант для начинающих, и я объясню, как им пользоваться ниже. Обратите внимание, что вам не нужно приобретать услугу Chatbox AI, которая представляет собой подписку, позволяющую получить доступ ко всем шаблонам LLM без необходимости самостоятельной установки Ollama.

-

Чтобы использовать лучший интерфейс чата с искусственным интеллектом, перейдите по ссылке: страница загрузки Скачайте версию для вашего Mac.

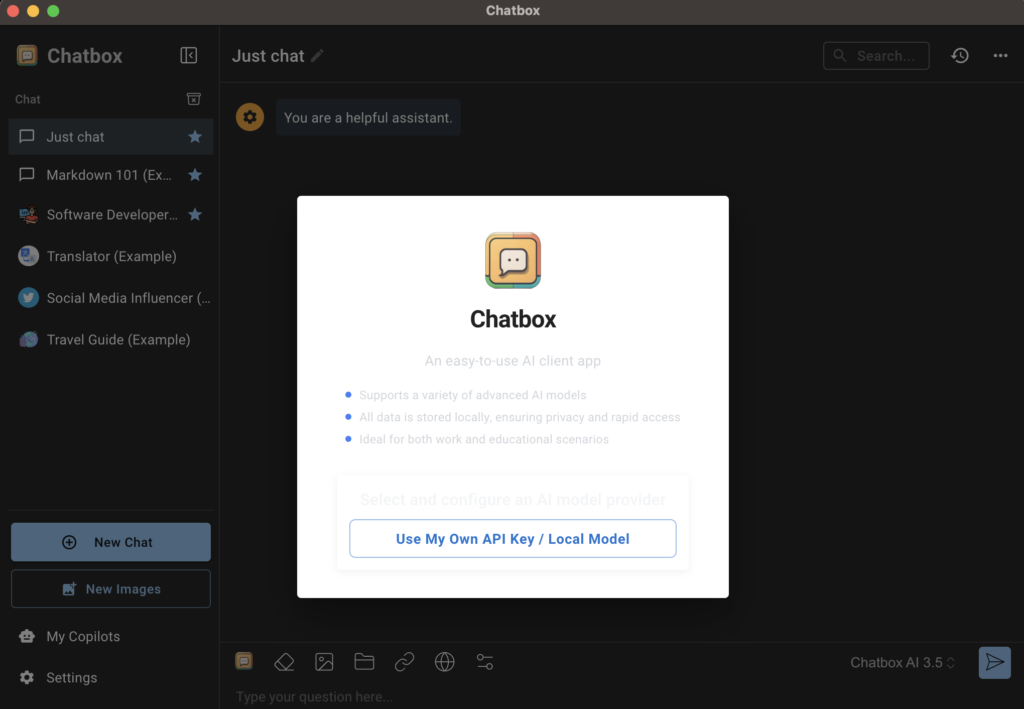

Далее откройте установщик и запустите программу. На первом экране появится всплывающее окно с вопросом, как использовать Chatbox AI.

Вам нужно будет нажать кнопку. Использовать собственный API-ключ / Локальную модель.

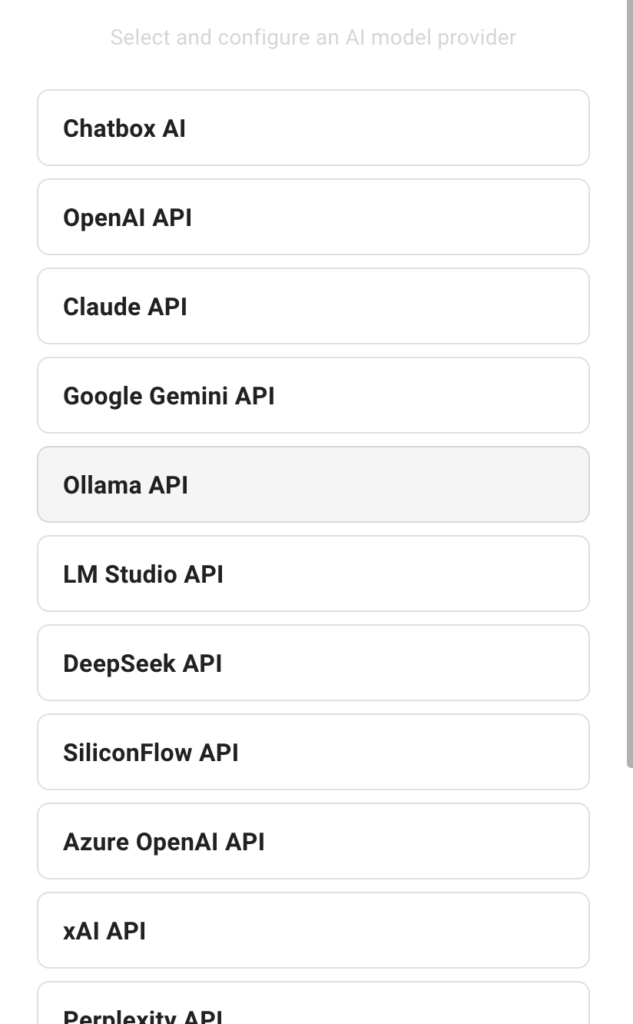

Далее коснитесь API Оллама Как поставщик моделей искусственного интеллекта.

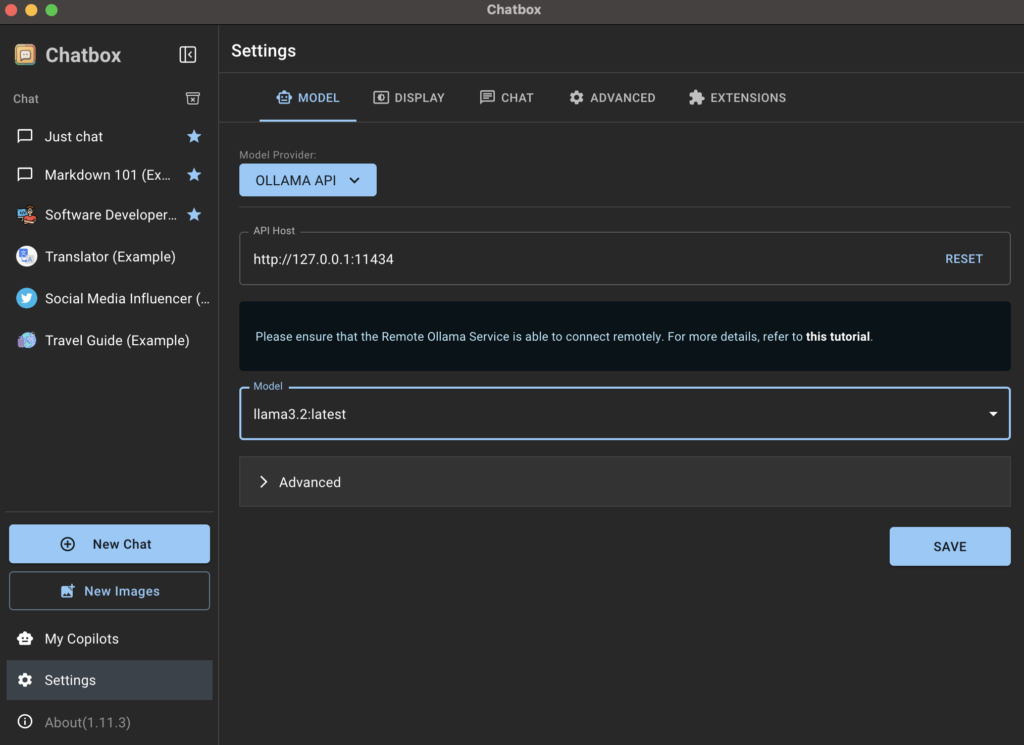

Chatbox AI должен автоматически определять, что Ollama запущена, и устанавливать хост API на значение по умолчанию, которое равно... Возвратный IP-адрес цикла и номер порта 11434Здесь ничего менять не нужно. Внутри формы вы должны увидеть формы, которые вы ранее установили с помощью Терминала. В моем случае это форма лама 3.2.

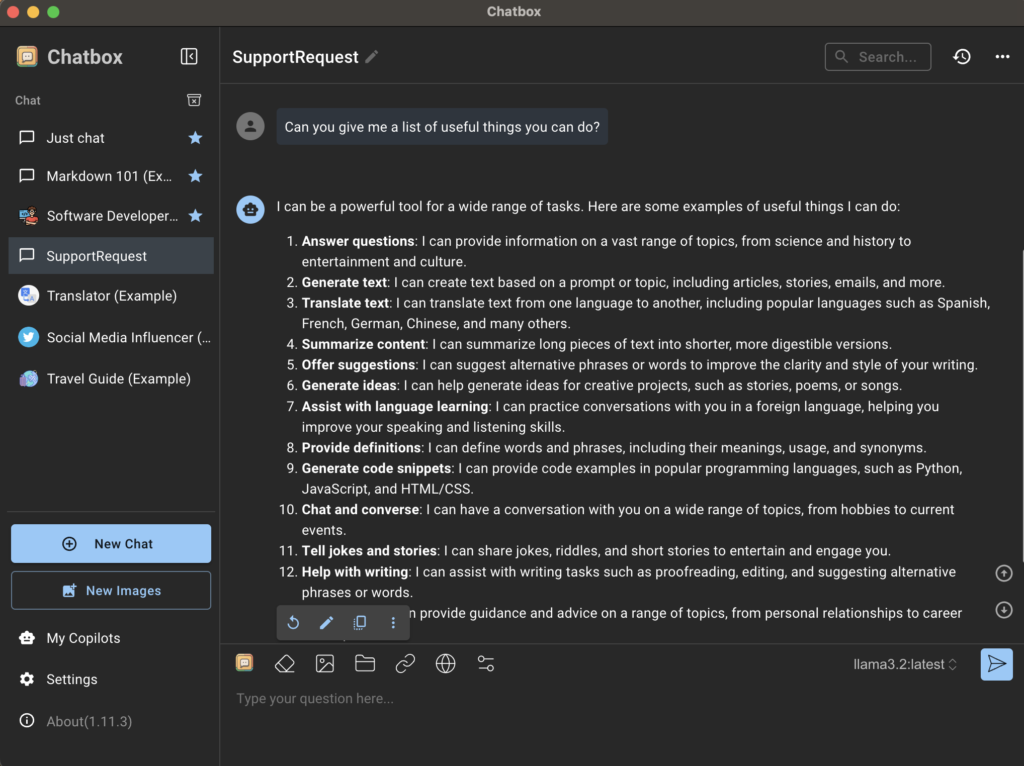

Вернувшись на главную страницу приложения, нажмите на Просто пообщаться Или Новый чат Убедитесь, что вы выбрали правильный шаблон в правом нижнем углу. Вы можете изменить шаблон в любое время, но я рекомендую создавать новый чат для каждого используемого шаблона, чтобы вы могли легко увидеть различия.

Альтернативные инструменты для локального запуска моделей LLM.

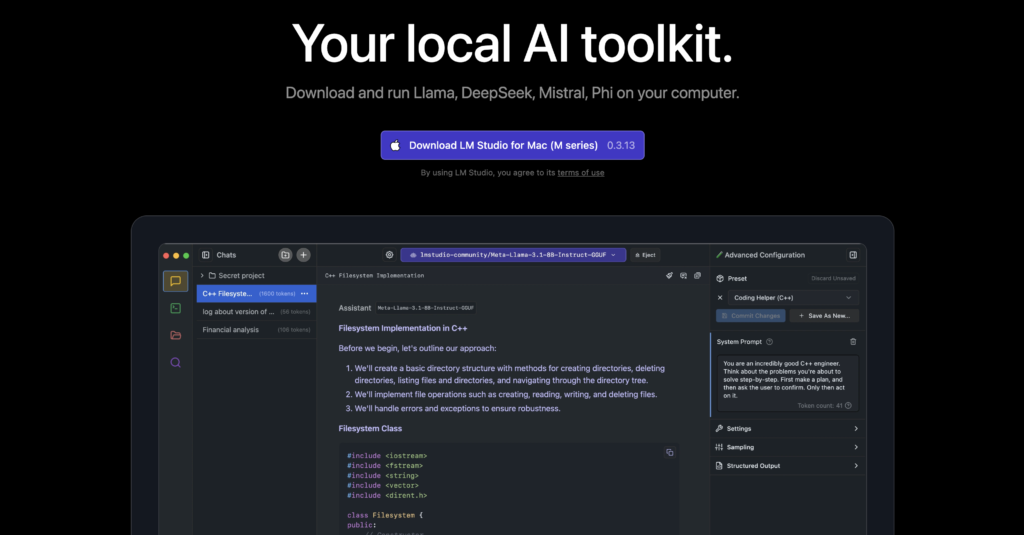

Если вы ищете альтернативы Ollama или предпочитаете более удобный интерфейс с самого начала, то ЛМ Студия Это ещё один отличный вариант. Он предлагает удобный интерфейс для изучения и использования различных моделей ИИ, позволяя легко загружать и запускать их. LM Studio доступен для Linux, Mac и Windows и предлагает такие функции, как настройка параметров модели и истории чата. В настоящее время он бесплатен, поэтому я рекомендую его вместо платного сервиса Chatbox AI.

Заключение

Запуск больших языковых моделей (LLM) локально на вашем Mac будет важен для всех, кто хочет получить больший контроль над своими приложениями искусственного интеллекта и уделять приоритетное внимание конфиденциальности данных. С помощью таких инструментов, как Ollama, и упомянутых выше графических интерфейсов, которые упрощают интеграцию LLM в ваш рабочий процесс, вы можете безопасно раскрыть новый потенциал производительности и творчества.

Однако для запуска локального развертывания LLM необходимо понимать параметры и то, как они влияют на производительность этих моделей на вашей конкретной машине. Лучший способ это понять — поэкспериментировать с различными моделями, чтобы определить, какие из них дают наилучшие результаты. Как только вы поймете эту концепцию, вы сможете принимать более взвешенные решения о том, какие модели использовать и как оптимизировать их производительность в соответствии с вашими конкретными потребностями.

Комментарии закрыты.