Как установить и использовать Ollama для запуска больших языковых моделей (LLM) на компьютере с Windows 11

Существует несколько способов локального запуска больших языковых моделей (LLM) на компьютере Windows, и Ollama — один из самых простых и эффективных.

Наиболее распространенное взаимодействие большинства из нас с ИИ в настоящее время осуществляется через облачные инструменты, такие как ChatGPT Или CopilotДля использования этих инструментов требуется подключение к Интернету, но их можно использовать практически на любом устройстве.

Но не все хотят полагаться на облако для приложений ИИ, особенно разработчики. Поэтому вы хотите, чтобы ваша большая языковая модель (LLM) работала локально на вашей машине. Вот тут-то и появляется Ollama.

Ollama — это инструмент вывода, который позволяет вам запускать широкий спектр больших языковых моделей (LLM) на вашем компьютере. Это не единственный способ сделать это, но это один из самых простых и понятных. Ollama позволяет вам использовать мощь ИИ без необходимости постоянного подключения к Интернету, предоставляя вам полный контроль над вашими данными и конфиденциальностью.

После того, как вы запустите Ollama и запустите его, вы сможете многое сделать с помощью Ollama и больших языковых моделей (LLM), которые он использует, но первым шагом является настройка. Давайте проведем вас через этот процесс шаг за шагом, чтобы вы могли получить максимальную отдачу от этого мощного инструмента.

Системные требования Оллама

Запуск Ollama сам по себе не потребляет много системных ресурсов и может быть запущен на широком спектре устройств. Он совместим с Windows 11, macOS и Linux. Вы даже можете использовать его из своих дистрибутивов Linux в Windows 11 через WSL.

Но для запуска больших языковых моделей (LLM) требуется более мощное оборудование. Чем больше модель, тем больше вычислительной мощности вам нужно. Для запуска этих моделей требуется графический процессор (GPU). В настоящее время они не оптимизированы для нейронного процессора (NPU) в новых ПК Copilot+.

К счастью, есть небольшие модели, которые можно использовать на скромном оборудовании. Например, модель Gemma 3 от Google имеет модель с 1 миллиардом параметров, которая требует всего 2.3 ГБ визуальной памяти с произвольным доступом (VRAM) для запуска полной модели. Это число увеличивается до более чем 9 ГБ VRAM, если вы переходите к модели с 4 миллиардами параметров.

Аналогично с Llama 3.2 от Meta, где для успешной работы модели с 1 миллиардом параметров требуется GPU с всего 4 ГБ VRAM. Затем этот объем увеличивается до 8 ГБ для модели с 3 миллиардами параметров.

Короче говоря, если у вас относительно современный компьютер с объемом оперативной памяти не менее 8 ГБ и выделенным графическим процессором, вы сможете получить некоторую выгоду от использования Ollama.

Руководство по установке Ollama на Windows 11

Установка Ollama на Windows 11 — очень простой процесс, который кратко описан в разделе «Загрузка». Установите программу с официального сайта Или из Репозиторий GitHub, затем установите его на свое устройство.

Вот простые шаги.

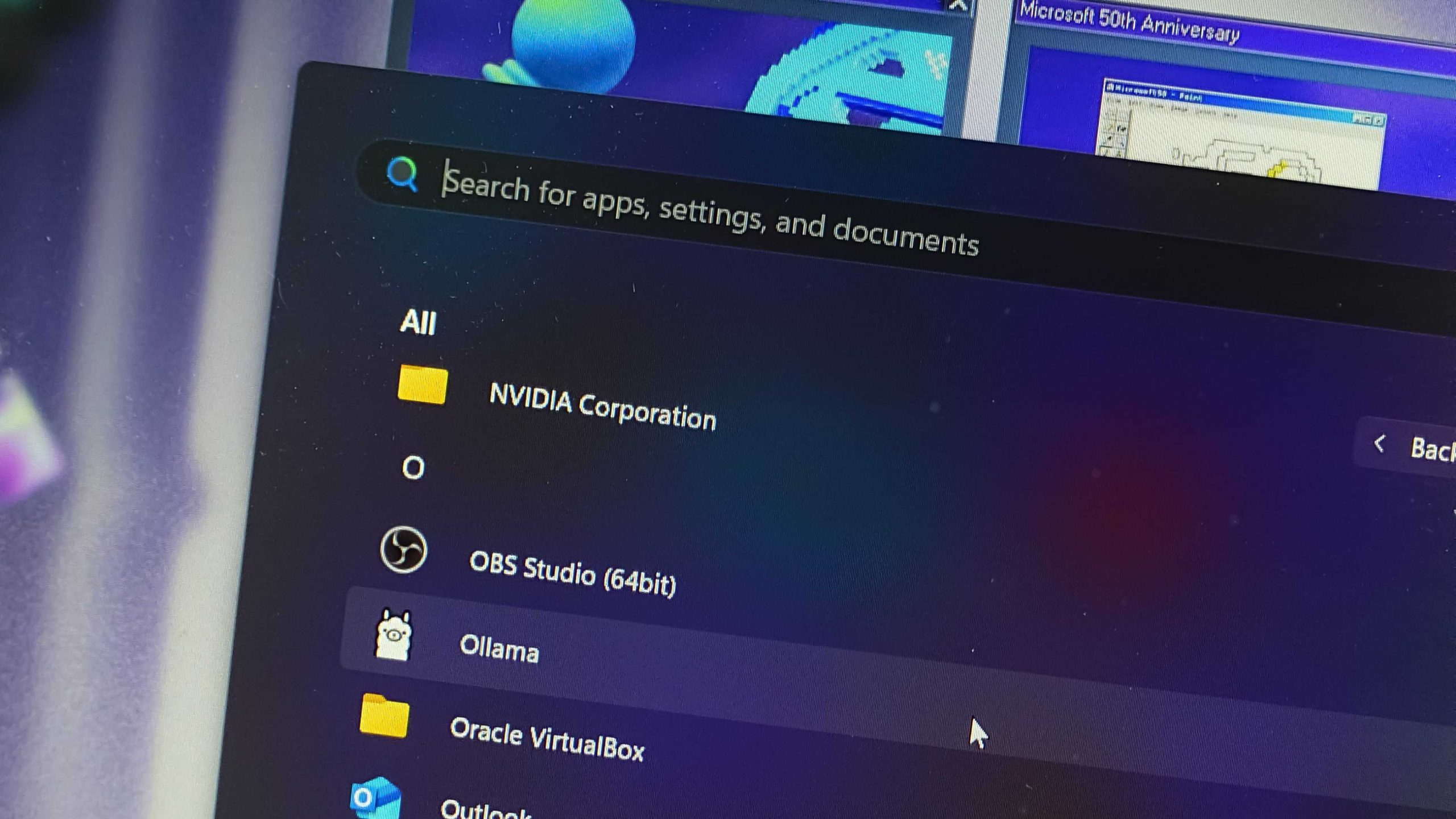

После установки и запуска на рабочем столе ничего не появится. Программа работает полностью в фоновом режиме, но вы можете видеть ее значок на панели задач.

Чтобы убедиться в корректной работе программы, вы можете перейти по адресу локальный: 11434 в вашем веб-браузере.

Установите и запустите свою первую большую языковую модель (LLM) на Ollama

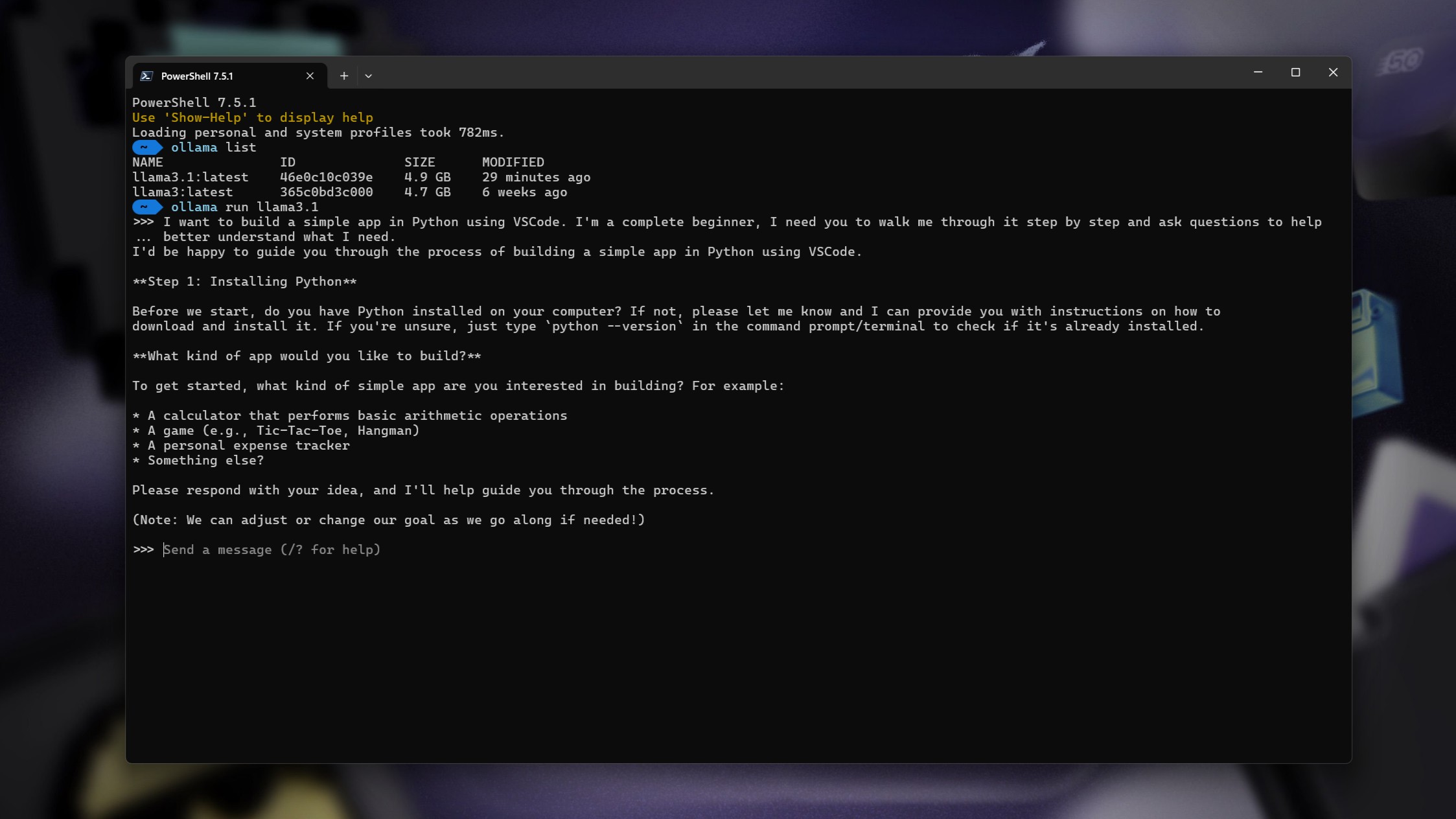

Чтобы запустить свою первую большую языковую модель (LLM) с помощью Ollama, вам в первую очередь понадобится использовать интерфейс командной строки (CLI). Откройте PowerShell в Windows или используйте WSL, если у вас установлена Ollama.

Хотя для Ollama существуют графические пользовательские интерфейсы (GUI), мы здесь сосредоточимся на использовании командной строки. Это полезно, если вам удобно использовать CLI.

Две основные вещи, которые вам нужно знать:

бегать

поставь это

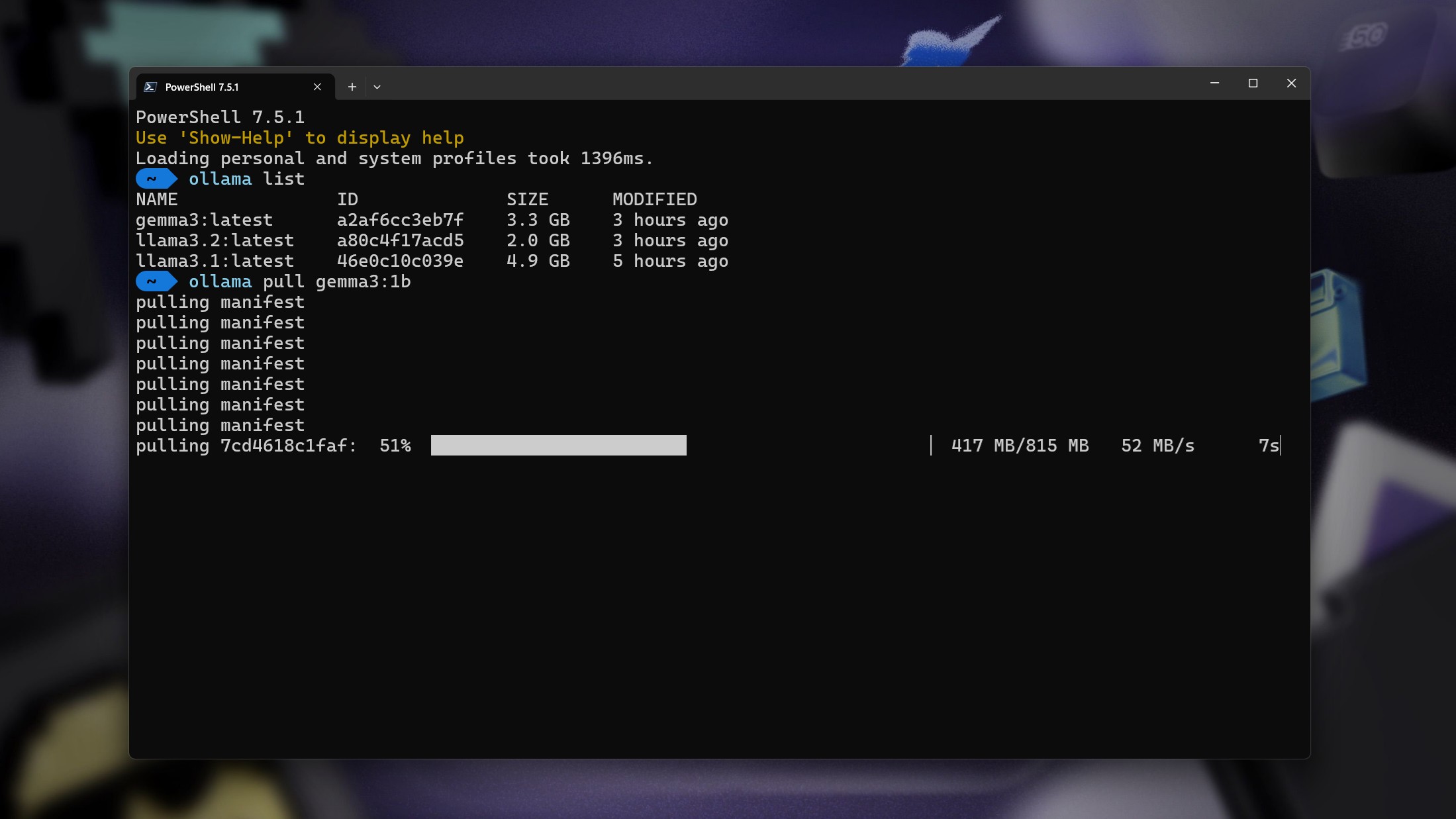

Если вы попросите Ollama запустить модель LLM, которая в данный момент не установлена, она автоматически сначала загрузит ее, а затем запустит. Вы можете легко найти правильные имена для больших языковых моделей, которые вы хотите установить, на Сайт Оллама.

Например, чтобы установить и запустить модель Google Gemma 3 LLM с 1 миллиардом параметров, введите следующую команду:

оллама беги Джемма:1б

Обратите внимание, что добавление :1б После имени укажите, что вам нужна модель с 1 миллиардом параметров. Если вам нужна модель с 4 миллиардами параметров, измените ее на **:4b**.

Запуск форм на вашем терминале откроет вам привычный интерфейс чат-бота, позволяющий вам писать свои запросы и получать ответы, и все это будет работать локально на вашем устройстве.

Чтобы выйти из формы и вернуться в PowerShell, просто введите **/bye**, и процесс будет завершен.

Это охватывает абсолютные основы настройки Ollama на вашем компьютере для использования набора LLM, доступных для него. Базовый опыт очень прост и удобен в использовании, не требуя практически никаких технических знаний для настройки. Если я смог это сделать, вы тоже сможете!

Комментарии закрыты.