Как ИИ меняет повседневные задачи специалистов по обработке данных

От устранения малоценных задач до ускорения высокоэффективных проектов — вот как ИИ меняет рабочие процессы в области науки о данных.

В своих предыдущих статьях я исследовал и сравнивал несколько инструментов ИИ, например, Data Science Agent от Google, ChatGPT против Клода против Gemini Для науки о данных и ДипСик V3и т. д. Однако это лишь малая часть всех инструментов ИИ, доступных для Наука данных. Вот некоторые из инструментов, которые я использовал в своей работе:

- API OpenAI: Я использую его для классификации и обобщения отзывов клиентов, а также для выявления слабых сторон продукта.

- ChatGPT и GeminiОни помогают мне составлять сообщения и электронные письма в Slack, писать аналитические отчеты и даже обзоры производительности.

- Подбирать ИИ:Glean использовал ИИ для быстрого поиска ответов в документах и внутренних сообщениях.

- Курсор и Copilot: Мне нравится просто нажимать Tab-Tab для автоматического заполнения кода и комментариев.

- Хекс МагияЯ использую Hex для совместной работы с электронными таблицами на работе. Он также предлагает функцию, называемую Хекс Магия Написание кода и исправление ошибок с использованием разговорного ИИ.

- Снежинка КортексCortex AI позволяет пользователям вызывать конечные точки LLM, создавать RAG и службы преобразования текста в SQL, используя данные в Snowflake.

Уверен, вы могли бы дополнить этот список, ведь новые инструменты ИИ появляются каждый день. На данный момент составить полный список практически невозможно. Поэтому в этой статье я хотел бы сделать шаг назад и сосредоточиться на более важном вопросе: Что нам на самом деле нужно как профессионалам в области данных и как ИИ может нам помочь?؟

В разделе ниже я сосредоточусь на двух основных тенденциях — устранении малоценных задач и ускорении высокоценной работы.

1. Исключите малоценные задачи.

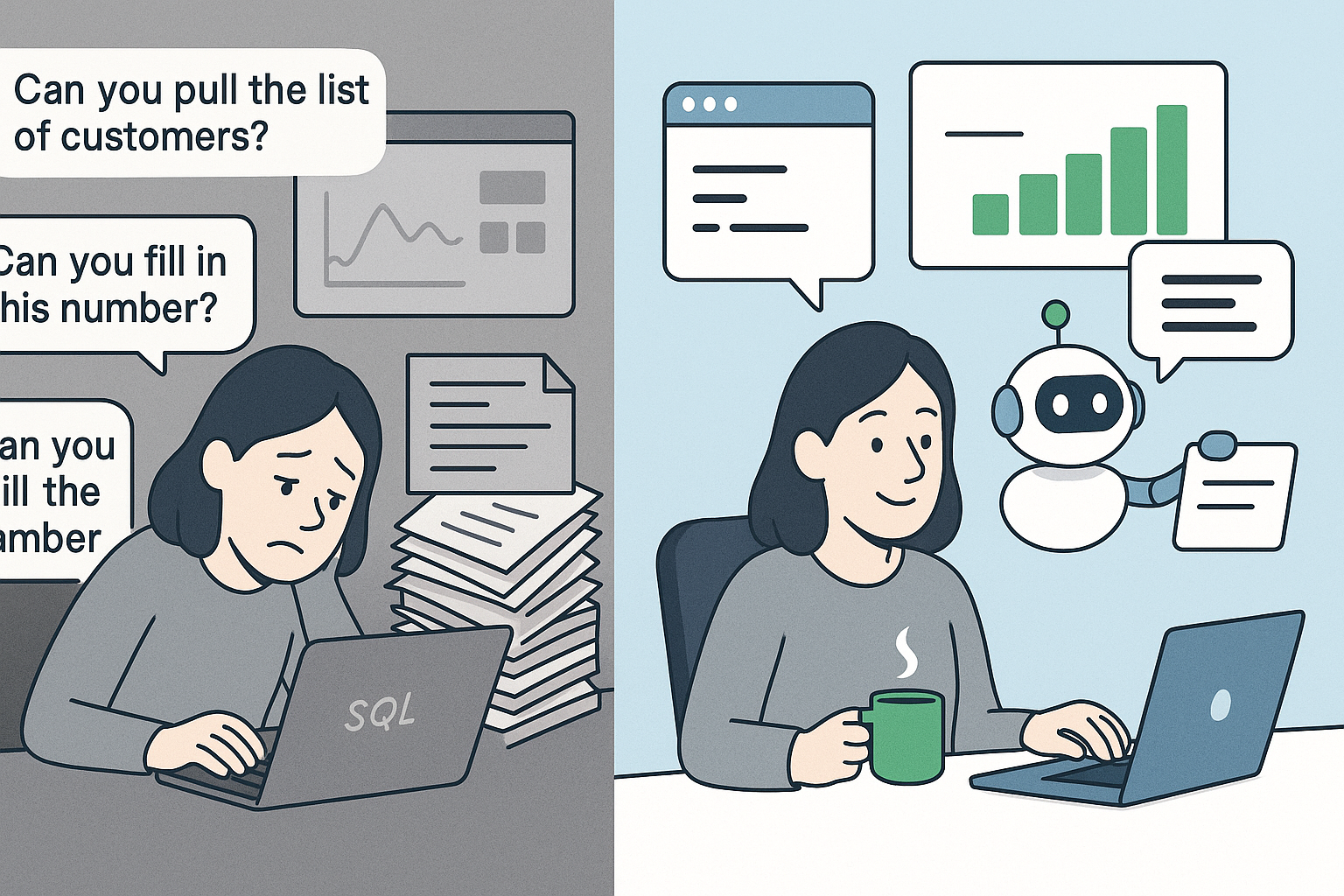

Я стал специалистом по анализу данных, потому что мне действительно нравится извлекать бизнес-информацию из сложных данных и принимать на ее основе бизнес-решения. Однако, работая в этой сфере уже более 7 лет, я должен признать, что не вся работа столь увлекательна, как я надеялся. Прежде чем мы сможем выполнять расширенную аналитику или строить модели машинного обучения, необходимо выполнить множество малоценных рабочих процессов, которых невозможно избежать ежедневно, — и во многих случаях это происходит из-за того, что у нас нет необходимых инструментов, чтобы предоставить заинтересованным сторонам возможность самостоятельной аналитики. Давайте рассмотрим нашу сегодняшнюю ситуацию и идеальный случай:

Текущий статус: Мы выступаем в роли интерпретаторов и контролеров данных (иногда «SQL-обезьяны»).

- Простые запросы на извлечение данных Каждую неделю она приходит ко мне и моей команде в Slack и спрашивает: «Какова была ваша валовая стоимость товара (GMV) в прошлом месяце?» «Можете ли вы составить список клиентов, которые соответствуют этим критериям?» «Можете ли вы помочь мне заполнить этот номер для презентации, которую мне нужно провести завтра?»

- Инструменты бизнес-аналитики (BI) не очень хорошо поддерживают сценарии самостоятельного использования.. Мы внедрили инструменты бизнес-аналитики, такие как Looker и Tableau, чтобы заинтересованные стороны могли легко изучать данные и отслеживать показатели. Но правда в том, что всегда приходится искать компромисс между простотой и возможностью самообслуживания. Иногда мы делаем панели мониторинга простыми для понимания с помощью нескольких показателей, но они могут использоваться только в ограниченном количестве случаев. В то же время, если мы сделаем инструмент в высшей степени настраиваемым с возможностью свободного изучения базовых показателей и данных, заинтересованные стороны могут посчитать инструмент запутанным и не иметь уверенности в его использовании, а в худшем случае данные могут быть извлечены и неверно истолкованы.

- Документов мало или они устарели.. Это распространенная ситуация, но она может быть вызвана разными причинами: возможно, мы действуем быстро и сосредоточены на достижении результатов, или же отсутствуют эффективные политики документирования данных и управления ими. В результате племенные знания становятся узким местом для людей, не входящих в команду по обработке данных, при использовании данных.

Идеальный случай: предоставить заинтересованным сторонам возможность самообслуживания, чтобы мы могли сократить объем малоценной работы.

- Заинтересованные стороны могут легко и уверенно выполнять простой сбор данных и отвечать на основные вопросы, связанные с данными.

- Группы по работе с данными тратят меньше времени на подготовку повторяющихся отчетов или простых разовых запросов.

- Панели мониторинга можно обнаружить, интерпретировать и использовать без непосредственной помощи.

Итак, какую роль может сыграть ИИ, чтобы приблизиться к идеальному состоянию? По моим наблюдениям, вот общие тенденции, к которым стремятся инструменты ИИ, чтобы преодолеть этот разрыв:

- Запрос данных на естественном языке (текст в SQL)Одним из способов снижения технического барьера является предоставление заинтересованным сторонам возможности запрашивать данные на естественном языке. В отрасли существует множество проектов по преобразованию текста в SQL:

- Например, Снежинка Это одна из компаний, которая достигла большого прогресса в Модели Text2SQL И начал интегрировать эту возможность в свой продукт.

- Многие компании (включая мою) также исследовали решения Text2SQL для внутренних нужд. Например, я участвовал Uber Ее путешествие с Запрос UberGPT Упростить запрос данных для своей операционной группы. В этой статье подробно описано, как Uber разработала многоагентную архитектуру для генерации запросов. В то же время были выявлены и существенные проблемы в этой области, включая точную интерпретацию намерений пользователя, обработку больших табличных графиков, предотвращение галлюцинаций и т. д.

- Честно говоря, чтобы заставить Text-to-SQL работать, вам нужно сделать запрос очень точным на очень высоком уровне — даже если инструмент даст сбой всего один раз, это может подорвать доверие, и в конечном итоге заинтересованные стороны вернутся к вам для проверки запросов (а затем вам придется читать и переписывать запросы, что почти удваивает объем работы 🙁). До сих пор я не нашел шаблона или инструмента Text-to-SQL, который работал бы идеально. Я считаю, что это достижимо только при запросе очень небольшого подмножества хорошо документированных базовых наборов данных для конкретных стандартизированных вариантов использования, но его очень сложно масштабировать, чтобы включить все доступные данные и различные бизнес-сценарии.

- Но, конечно, учитывая огромные инвестиции в эту сферу и быстрое развитие ИИ, я уверен, что мы будем все ближе и ближе подходить к точным и масштабируемым решениям преобразования текста в SQL.

- Чат-помощник по бизнес-аналитике (BI)Еще одной популярной областью для улучшения взаимодействия заинтересованных сторон с инструментами бизнес-аналитики является чат-помощник бизнес-аналитики. На самом деле это на шаг впереди Text-to-SQL — вместо генерации SQL-запроса на основе подсказки пользователя, он отвечает в формате визуализации, а также в виде текстового резюме.

- Близнецы в Looker Он является примером здесь. Looker принадлежит Google, поэтому интеграция с Gemini вполне закономерна. Еще одним преимуществом Looker при построении своего ИИ является то, что поля данных уже задокументированы в семантическом слое LookML, при этом определены общие сопоставления и включены общие метрики в панели мониторинга. Итак, у нас есть много полезных данных, из которых можно извлечь уроки. Gemini позволяет пользователям настраивать панели инструментов Looker, задавать вопросы о данных и даже создавать собственные агенты данных для диалоговой аналитики. Хотя, исходя из моего ограниченного опыта работы с этим инструментом, порой он не дает ответа даже на простые вопросы. Дайте мне знать, если у вас был другой опыт и вам удалось это сделать…

- Tableau также запустила похожую функцию, Таблица ИИ. Я сам им не пользовался, но, судя по демонстрации, он помогает команде по работе с данными подготавливать данные, быстро создавать панели мониторинга с использованием естественного языка и обобщать аналитические данные в Tableau Pulse, чтобы заинтересованные стороны могли легко выявлять изменения показателей и аномальные тенденции.

- Инструменты индексации данныхИИ также может помочь решить проблему недостаточного документирования данных или его отсутствия.

- Я помню, как во время внутреннего хакатона одним из проектов наших инженеров по работе с данными было использование LLM для расширения охвата документации таблиц. ИИ способен читать кодовую базу и описывать столбцы соответствующим образом с высокой точностью в большинстве случаев, поэтому он может помочь быстро улучшить документацию с ограниченной проверкой и изменениями со стороны человека.

- Аналогично, когда моя команда создает новые таблицы, мы начали просить Cursor писать файлы YAML для документации таблиц, чтобы сэкономить нам время и получить высококачественный вывод.

- Существует также множество каталогов данных и инструментов управления, интегрированных с ИИ. Когда я гуглю «индекс данных ИИ», я вижу логотипы инструментов индексации данных, таких как Atlan, Alation, Collibra, Informatica и т. д. (Отказ от ответственности: я не использовал ни один из них). Это явная тенденция отрасли.

2. Ускорение выполнения высокоценной работы

Теперь, когда мы обсудили, как ИИ может помочь устранить малоценные задачи, давайте обсудим, как он может ускорить выполнение высокоценных проектов по обработке данных. Под «работой высокой ценности» здесь понимаются проекты по работе с данными, которые сочетают техническое совершенство с бизнес-контекстом и достигают значимого эффекта посредством кросс-функционального сотрудничества. Например, глубокий анализ, который позволяет понять закономерности использования продукта и приводит к изменению продукта, или модель прогнозирования оттока клиентов, позволяющая выявить клиентов, подверженных риску оттока, и приводящая к инициативам по предотвращению оттока. Давайте сравним текущую ситуацию с идеальным будущим:

Текущее состояние: имеются узкие места Продуктивность В ежедневном рабочем процессе

- Исследовательский анализ данных (ИАД) занимает много времени.. Этот шаг необходим для первоначального понимания данных, однако выполнение всех одномерных и многомерных анализов может занять много времени.

- Время, потраченное на кодирование и отладку. Будем честны — никто не может запомнить все параметры моделей numpy, pandas и sklearn. В процессе кодирования нам постоянно приходится искать документацию.

- Обширные неструктурированные данные не используются в полной мере.. Компании ежедневно генерируют большой объем текстовых данных из опросов, заявок в службу поддержки и отзывов. Однако извлечение информации в масштабируемом виде остается проблемой.

Идеальный случай: специалисты по данным сосредоточены на глубоком мышлении, а не на синтаксисе.

- Написание кода происходит быстрее без необходимости заглядывать в синтаксис.

- Аналитики тратят больше времени на интерпретацию результатов и меньше на работу с данными.

- Неструктурированные данные больше не являются препятствием и могут быть быстро проанализированы.

Когда вы видите идеальный случай, я уверен, у вас уже есть на примете какие-то инструменты ИИ. Давайте посмотрим, как ИИ может на самом деле повлиять или изменить ситуацию:

- ИИ-помощники для кодирования и отладки. Я думаю, что это, безусловно, самый надежный тип инструмента ИИ для тех, кто пишет код. Мы уже видим, как это происходит снова.

- Когда чат-боты LLM нравятся ChatGPT и КлодИнженеры поняли, что они могут просто задавать вопросы по синтаксису или сообщения об ошибках чат-боту, который будет получать очень точные ответы. Это все еще нарушает ваш рабочий процесс кодирования, но это намного лучше, чем пролистывать десятки вкладок StackOverflow — а это уже кажется прошлым веком.

- Позже мы видим, что появляются все больше и больше интегрированных инструментов кодирования ИИ – интегрированных Второй пилот GitHub и Курсор С помощью вашего редактора кода они могут читать вашу кодовую базу, чтобы заблаговременно предлагать варианты автодополнения кода и отладки проблем в вашей IDE.

- Как я кратко упомянул в начале, такие инструменты обработки данных, как Снежинка и Hex В комплект также входят помощники по кодированию на основе искусственного интеллекта, которые помогают аналитикам и специалистам по работе с данными легко писать код.

- Искусственный интеллект для разведывательного анализа данных и анализа. Это чем-то похоже на чат-помощник BI, о котором я упоминал выше, но его цель более амбициозна — он начинает с необработанных наборов данных и стремится автоматизировать весь цикл анализа, включающий очистку данных, предварительную обработку, исследовательский анализ и иногда даже моделирование. Это инструменты, которые часто рекламируются как «заменители аналитиков данных» (но так ли это?).

- Агент Google Data Science Это очень впечатляющий новый инструмент, который может создать целый блокнот Jupyter с помощью простого запроса. Я недавно написал статья Объясняет, что он может делать, а что нет. Короче говоря, он может быстро создать хорошо организованный Jupyter Notebook, работающий на основе настраиваемого плана выполнения. Однако в нем отсутствуют возможности модификации Jupyter Notebook на основе контрольных вопросов, по-прежнему требуется человек с глубокими познаниями в области науки о данных для проверки методов и выполнения ручных итераций, а также требуется четкое изложение проблемы с данными с использованием чистых, хорошо документированных наборов данных. Поэтому я рассматриваю это как отличный инструмент, позволяющий сэкономить время на начальном коде, не ставя под угрозу нашу работу.

- Его также можно классифицировать как Инструмент аналитики данных ChatGPT В рамках этой сферы. Позволяет пользователям загружать набор данных и общаться с ним, чтобы завершить анализ, создать визуализации и ответить на вопросы. Вы можете найти мою предыдущую статью, в которой обсуждаются его возможности. здесь. Он также сталкивается с аналогичными проблемами и лучше работает в качестве помощника EDA, а не замены аналитиков данных.

- Возможности обработки естественного языка просты в использовании и масштабируемы.. Магистр права отлично умеет вести беседы. Таким образом, с появлением сегодняшней степени магистра права изучать НЛП стало значительно проще.

- Моя компания ежегодно проводит внутренний хакатон. Помню, три года назад в рамках моего хакатонного проекта я пытался использовать BERT и другие традиционные методы тематического моделирования для анализа ответов на опросы NPS. Это было интересно, но, честно говоря, очень сложно было сделать это точно и содержательно для бизнеса. Затем два года назад, во время хакатона, мы попробовали API OpenAI Что касается классификации и обобщения данных обратной связи, то это сработало просто идеально, обеспечив высокоточное тематическое моделирование, анализ настроений и классификацию отзывов всего за один вызов API, а выходные данные хорошо вписывались в наш бизнес-контекст, основываясь на системных подсказках. Позже мы создали внутренний конвейер, который легко расширялся для включения текстовых данных из ответов на опросы, заявок в службу поддержки, звонков от продавцов, заметок об исследованиях пользователей и т. д. Он стал центральным узлом для сбора отзывов клиентов и повлиял на нашу дорожную карту продукта. Вы можете найти Plus на сайте Этот технический блог.

- Также появилось много новых компаний, создающих инструменты аналитики отзывов клиентов на базе искусственного интеллекта, инструменты аналитики обзоров продуктов, инструменты помощников по обслуживанию клиентов и многое другое. Идеи все те же — использование того, как LLM может понимать контекст текста и вести беседы, для создания агентов ИИ, специализирующихся на анализе текста.

Заключение

Легко увлечься новейшими инструментами искусственного интеллекта (ИИ). Но в конечном итоге самое важное — это использование ИИ для устранения того, что нас замедляет, и ускорения того, что движет нас вперед. Главное — оставаться прагматичным: использовать то, что работает сегодня, проявлять интерес к тому, что появляется, и никогда не упускать из виду основную цель науки о данных — принимать более обоснованные решения за счет лучшего понимания.

Комментарии закрыты.