Microsoft запускает Phi-4: сверхинференциальную модель искусственного интеллекта, которая будет конкурировать с DeepSeek R1

Краткое содержание:

- Microsoft запустила модели логического вывода ИИ Phi-4, обученные с использованием 14 миллиардов и 3.8 миллиарда параметров.

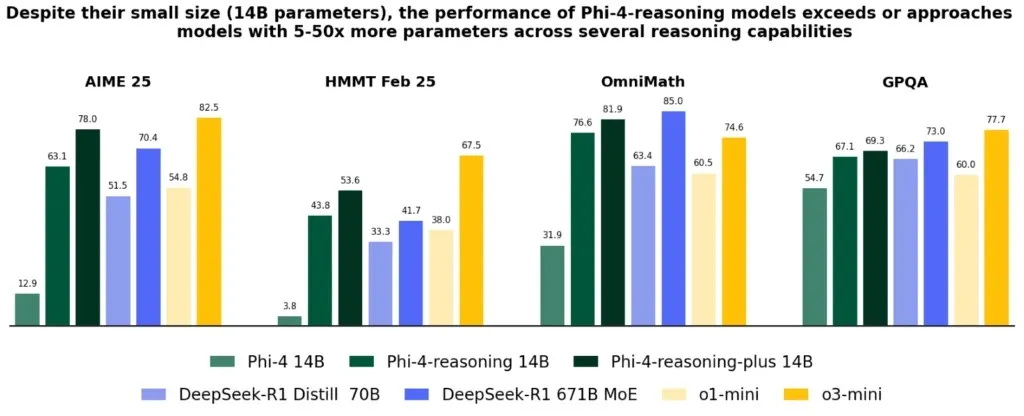

- Несмотря на свои небольшие размеры, модели вывода Phi-4 конкурируют с гораздо более крупными моделями, такими как DeepSeek R1 и o3-mini.

- По словам Microsoft, модели вывода Phi-4 могут работать на ПК под управлением Windows Copilot+ благодаря своему небольшому размеру.

Microsoft запустила три новые дедуктивные модели искусственного интеллекта, включая Phi-4-reasoning, Phi-4-reasoning-plus и Phi-4-mini-reasoning. Это небольшие языковые модели, разработанные для терминальных устройств, таких как компьютеры Windows и мобильные устройства. Модель искусственного интеллекта Phi-4-reasoning обучена с использованием 14 миллиардов параметров и может выполнять сложные задачи вывода.

Модель Phi-4-reasoning-plus использует ту же базовую модель, но использует дополнительное время вычисления вывода, примерно в 1.5 раза большее количество токенов по сравнению с Phi-4-reasoning, для обеспечения более высокой точности. Несмотря на небольшой размер моделей Phi-4-reasoning, они конкурентоспособны по сравнению с более крупными моделями, такими как DeepSeek R1 671B и o3-mini.

В стандарте GPQA модель Phi-4-reasoning-plus-14B достигает оценки 69.3%, в то время как о3-мини 77.7%. Далее, в тесте AIME 2025 Phi-4-reasoning-plus-14B набирает 78%, а o3-mini — 82.5%. Далее показано, что малая модель Microsoft очень близка к основным моделям вывода, которые гораздо больше по размеру.

По данным Microsoft, модели вывода Phi-4 обучались с помощью контролируемой тонкой настройки.О тщательно подобранных демонстрациях вывода от OpenAI o3-mini. Кроме того, Microsoft пишет: «Модель демонстрирует, что точное форматирование данных и высококачественные синтетические наборы данных позволяют меньшим моделям конкурировать с большими моделями.".

Помимо этого, меньшая модель рассуждений Phi-4-mini, обученная всего с 3.8 миллиардами параметров, превосходит многие модели 7B и 8B. В таких бенчмарках, как AIME 24, MATH 500 и GPQA Diamond, модель Phi-4-mini-reasoning-3.8B показывает конкурентоспособные результаты, приближаясь к уровню o1-mini. Это было завершено "РегулироватьМодель Phi-4-miniТочное использование синтетических данных, полученных с помощью модели Deepseek-R1".

Модели Phi от Microsoft уже изначально используются на компьютерах Windows. Второй пилот+ ПКОн использует преимущества встроенного нейронного процессора. Будет интересно посмотреть, как модели вывода Phi-4 улучшат производительность искусственного интеллекта на устройстве.

Комментарии закрыты.