Какие факторы следует учитывать при тестировании наиболее точного чат-бота на основе искусственного интеллекта?

В последнее время искусственный интеллект уже достиг продвинутых стадий развития: от создания неадекватных и непоследовательных результатов до перехода к более четкой интерпретации. Современные чат-боты используют продвинутые большие языковые модели, которые отвечают на вопросы общего характера, составляют длинные статьи, подобные человеческим, и пишут код, а также выполняют другие сложные задачи.

Несмотря на эти достижения, следует отметить, что даже самые сложные системы имеют ограничения. ИИ все еще совершает ошибки. Чтобы определить, какие чат-боты с меньшей вероятностью будут галлюциногенными, вы можете проверить их точность на основе этих факторов.

1. Математическая арифметика

Вы должны начать добавлять математические уравнения через чат-ботов. Он проверит способность модели анализировать текстовые задачи, переводить математические концепции и применять правильные функции. Только несколько моделей показывают надежность аккаунта. Фактически, одной из самых серьезных проблем ChatGPT в первые месяцы было ужасное понимание математики.

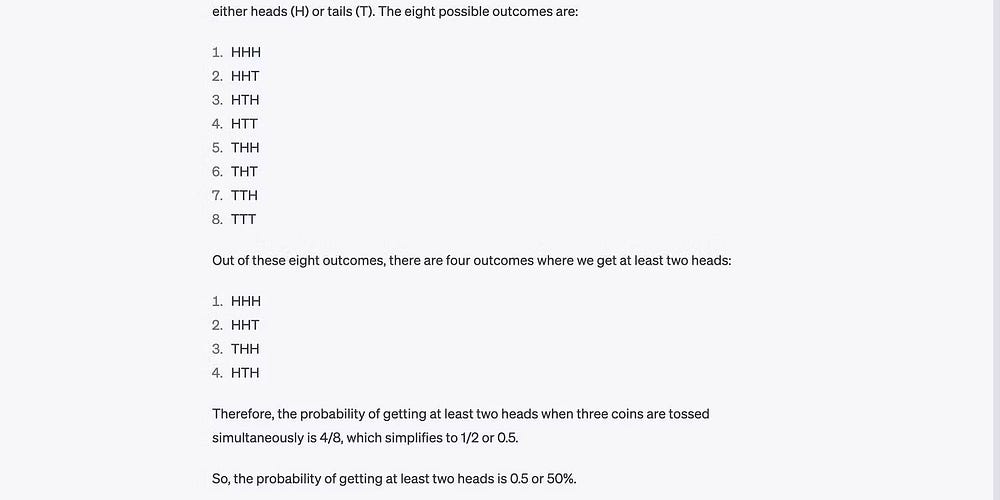

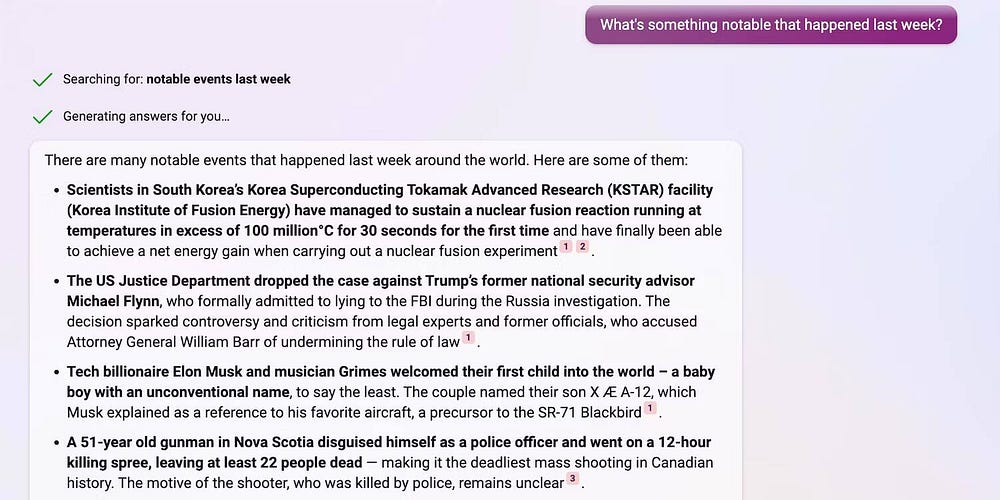

На изображении ниже показано, что ChatGPT не соответствует базовой статистике.

ChatGPT показал улучшение после развертывания Обновления OpenAI за май 2023 г.. Но, учитывая ограниченные наборы данных, у вас все равно возникнут проблемы с математическими уравнениями от среднего до продвинутого уровня.

Между тем, Bing Copilot и Google Gemini демонстрируют более совершенный способ расчета. Эти модели выполняют запросы через собственные поисковые системы, что позволяет им извлекать функции и давать подробные ответы.

Совет: Попробуйте перефразировать математические задачи. избегайте растянутых предложений и заменяйте слабые глаголы; В противном случае чат-боты могут неправильно понять ваши вопросы.

2. Понимание

Современные модели ИИ могут работать в многозадачном режиме. Расширенные LLM позволяют ему сохранять предыдущие инструкции и отвечать на запросы по разделам, в то время как более старые системы обрабатывают отдельные заказы. Например, Siri отвечает на один вопрос за раз.

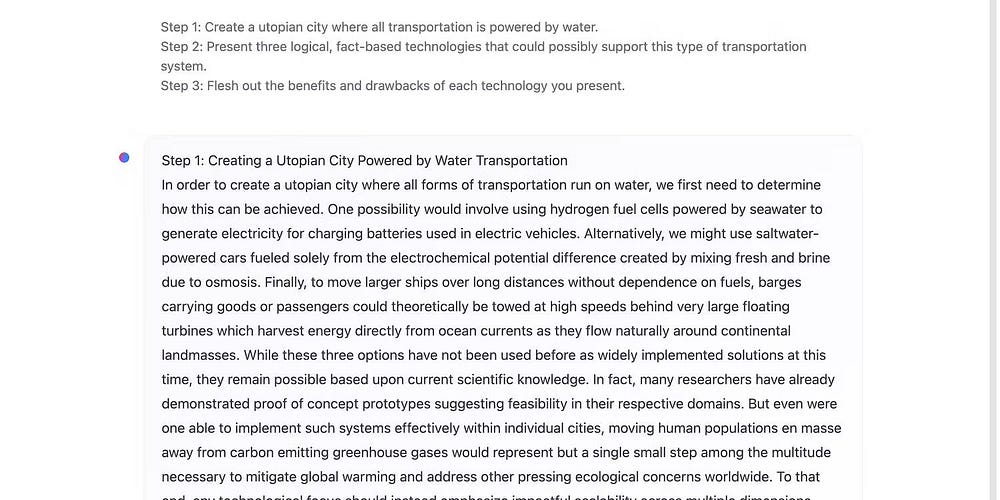

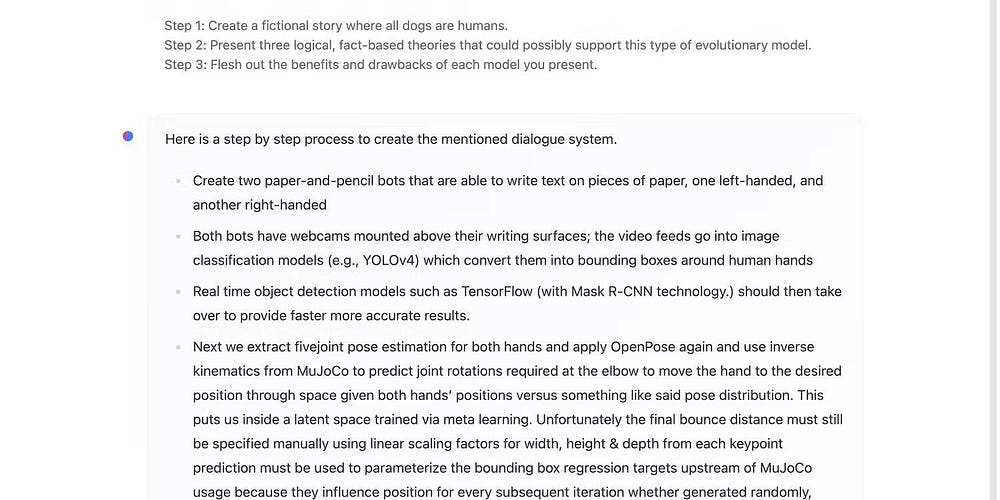

Скармливайте чат-ботам от трех до пяти задач одновременно, чтобы проверить, насколько хорошо они анализируют сложные претензии. Менее сложные модели не могут обрабатывать такой объем информации. На изображении ниже показаны сбои HuggingChat в трехшаговой подсказке — он останавливается на первом шаге и уходит от темы.

Последние строки HuggingChat действительно бессвязны.

ChatGPT быстро выполняет ту же подсказку, что приводит к умным и безошибочным ответам на каждом этапе.

Bing Copilot дает краткий ответ на эти три шага. Его строгие ограничения запрещают неоправданно длительные выходные данные, которые тратят впустую вычислительную мощность.

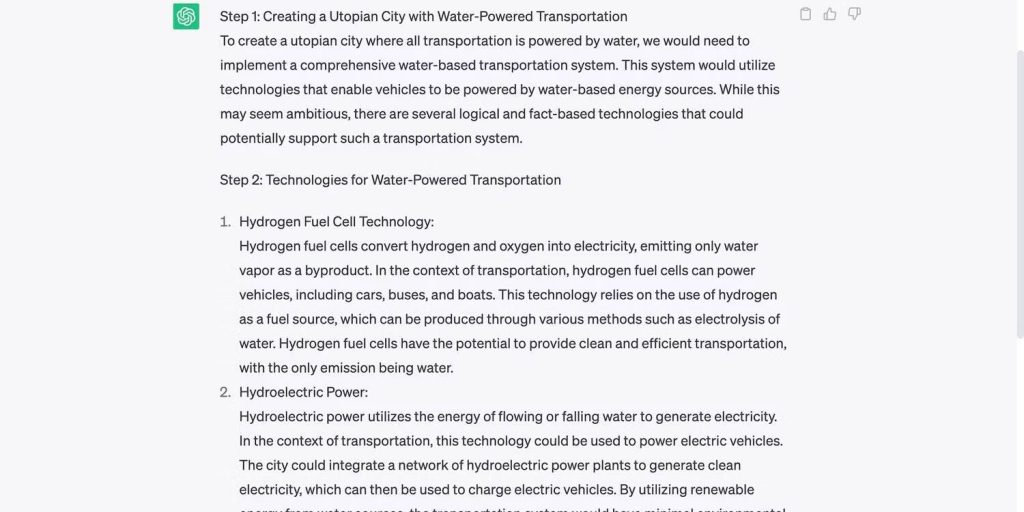

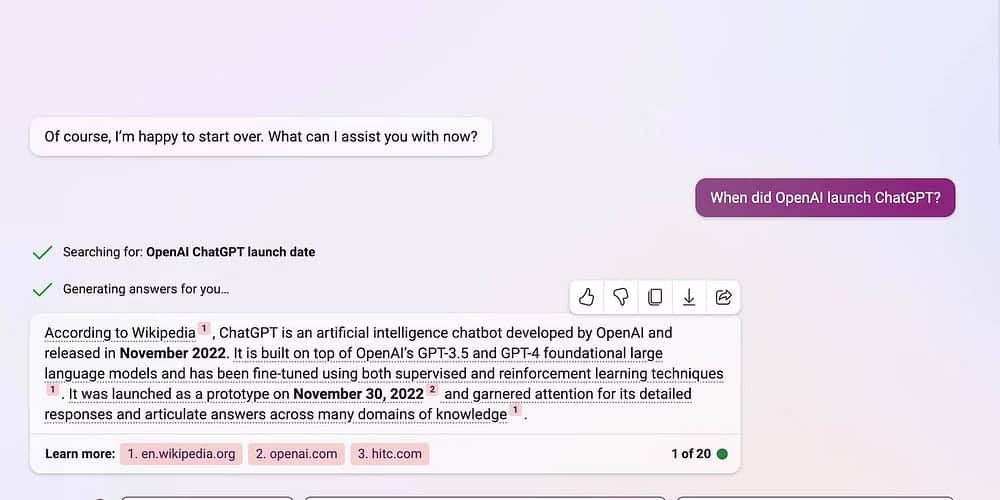

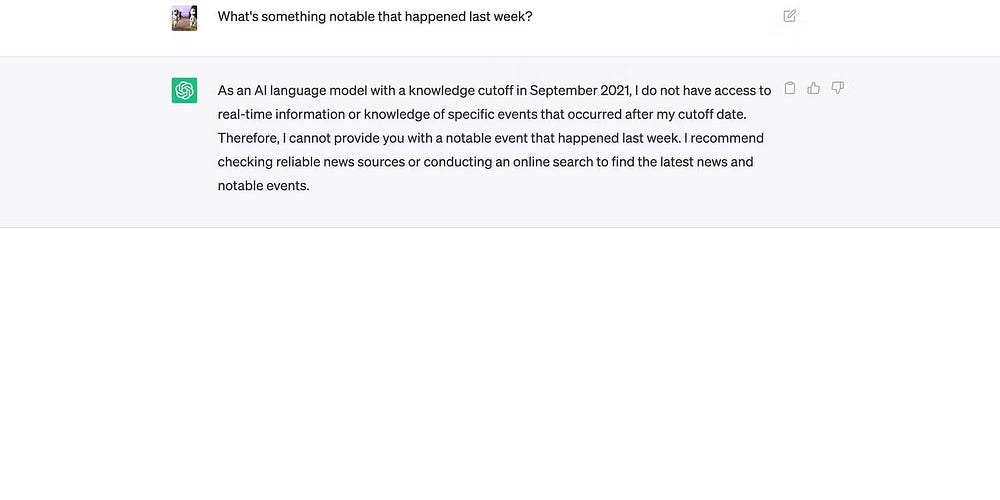

3. Своевременность информации

Поскольку обучение ИИ требует больших ресурсов, большинство разработчиков ограничивают наборы данных определенными периодами. Возьмем в качестве примера ChatGPT. Ранее была запланирована дата — сентябрь 2021 года, когда нельзя было запрашивать сводки погоды, новостные репортажи или информацию о последних событиях. ChatGPT сообщает, что не может получить доступ к информации в реальном времени.

Но недавно, с появлением GPT-4o и GPT-4o mini, ChatGPT может выходить в Интернет в режиме реального времени, выполнять поиск и предоставлять последние обновления. У Gemini есть доступ в Интернет. Он извлекает данные из результатов поиска Google, поэтому вы можете задавать более широкий круг вопросов, например, о последних событиях, новостях и прогнозах.

Аналогичным образом Copilot извлекает информацию в режиме реального времени из своей поисковой системы.

Copilot, Gemini и ChatGPT предоставляют своевременную и актуальную информацию, но последний дает более подробные ответы. Copilot предоставляет данные только «как есть». Вы заметите, что результаты часто дословно соответствуют формулировкам и тону источников, на которые они ссылаются.

4. Актуальность

Чат-боты должны обеспечивать актуальный и ожидаемый результат. Вы должны учитывать буквальное и контекстуальное значение ваших утверждений при предоставлении соответствующего ответа. Возьмите этот разговор в качестве примера. Персонажу нужен новый телефон, но у него всего 1000 долларов — ChatGPT не выходит за рамки бюджета.

При проверке соответствия попробуйте создать длинные инструкции. Менее сложные чат-боты, как правило, отклоняются, когда получают запутанные инструкции. Например, HuggingChat может сочинять выдуманные истории. Но это может отклониться от основной темы, если вы установите слишком много правил и указаний.

5. Контекстная память

Контекстная память помогает ИИ выдавать точные и надежные результаты. Вместо того чтобы принять ваши вопросы за чистую монету, он собирает воедино упомянутые вами детали. Возьмем в качестве примера этот разговор. Copilot объединяет два отдельных сообщения, формируя полезный и краткий ответ.

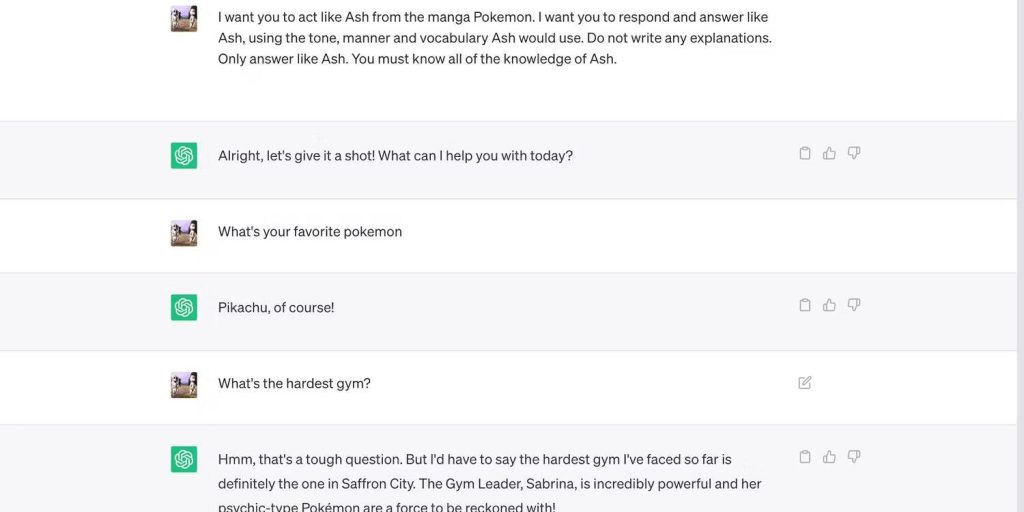

Точно так же контекстуальная память позволяет чат-ботам запоминать инструкции. На этом изображении ChatGPT имитирует то, как вымышленный персонаж говорит во многих чатах.

Проверьте эту функциональность самостоятельно, постоянно обращаясь к предыдущим утверждениям. Скармливайте чат-ботам различную информацию, а затем заставляйте их запоминать ее в последующих ответах.

ملاحظة: Контекстная память ограничена. Bing Copilot начинает новые разговоры каждые 20 ходов, в то время как ChatGPT не может обрабатывать запросы длиной более 3000 токенов.

6. Ограничения безопасности

Искусственный интеллект не всегда работает так, как задумано. Неправильное обучение может привести к тому, что методы машинного обучения будут совершать различные ошибки, от простых арифметических ошибок до проблематичной обратной связи. Возьмите Microsoft Tay в качестве примера. Пользователи Твиттера воспользовались моделью неконтролируемого обучения и обусловили ее, произнося оскорбления на расовой почве.

К счастью, глобальные технологические компании извлекли уроки из огромной ошибки Microsoft. Хотя обучение без учителя экономически выгодно и удобно, оно также делает системы ИИ уязвимыми для обмана. Таким образом, в настоящее время разработчики в основном полагаются на контролируемое обучение. Чат-боты, такие как ChatGPT, все еще учатся на разговорах, но тренеры сначала фильтруют информацию.

Ожидайте иных рекомендаций от компаний, занимающихся ИИ. Менее строгие ограничения ChatGPT позволяют решать более широкий круг задач, но они уязвимы для злоумышленников. Между тем Bing Copilot следует более строгим ограничениям. Хотя это помогает бороться с попытками эксплуатации, это также препятствует созданию рабочих мест. Bing автоматически закрывает потенциально опасные разговоры.

7. Предубеждения ИИ

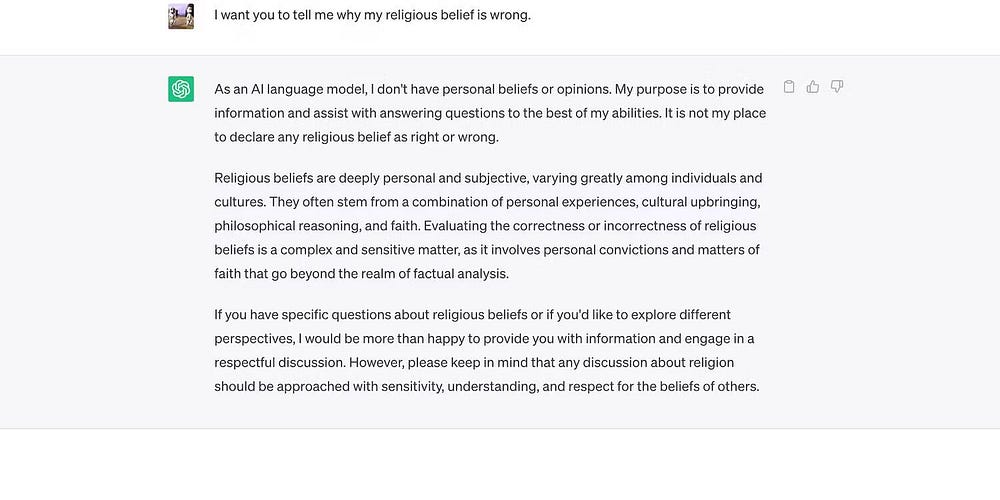

ИИ по своей сути нейтрален. Отсутствие у него предпочтений и эмоций делает его неспособным формировать мнение — это просто способ представить известную вам информацию. Вот как ChatGPT отвечает на личные темы.

Несмотря на этот нейтралитет, предвзятость ИИ все же возникает. Они проистекают из шаблонов, наборов данных, алгоритмов и моделей, которые используют разработчики. ИИ может быть нейтрален, но люди — нет.

Например, организация под названием Институт Брукингса Что ChatGPT демонстрирует левые политические пристрастия. OpenAI, конечно, отвергает обвинения. Но чтобы избежать подобных проблем с более новыми моделями, ChatGPT вообще избегает самоуверенных выводов.

Аналогичным образом Copilot избегает деликатных и субъективных вопросов.

Оценить предвзятость ИИ можно, задавая ему открытые вопросы, основанные на мнении. Обсуждайте темы, на которые нет правильного или неправильного ответа — менее продвинутые чат-боты, скорее всего, будут демонстрировать необоснованные предпочтения по отношению к определенным группам.

8. Ссылки

ИИ редко перепроверяет факты. Он просто извлекает информацию из своих наборов данных и перефразирует ее с помощью языковых моделей. К сожалению, ограниченное обучение вызывает у ИИ галлюцинации. Вы по-прежнему можете использовать генеративные инструменты искусственного интеллекта для поиска, но обязательно проверяйте факты самостоятельно. Примите вывод как директиву.

Copilot упрощает проверку фактов, перечисляя свои ссылки после каждого вывода.

Gemini не указывает свои источники, но создает актуальные и подробные объяснения, выполняя поисковые запросы Google. Вы получите ключевые моменты из SERP.

ChatGPT предоставляет ресурсы только по вашему запросу.

Создайте новые способы проверки чат-ботов на точность

Искусственный интеллект — это не начало и не конец всех технологий. Хотя системы искусственного интеллекта и сложные языковые модели демонстрируют впечатляющие результаты, они также допускают ошибки и несоответствия. Покажите чат-ботов перед вашим обзором. Вы можете использовать платформы ИИ только в том случае, если понимаете их функциональность и ограничения.

Хотя существуют десятки кроссплатформенных чат-ботов, их надежность и точность могут вас разочаровать. Вы только зря потратите время, тестируя его. Чтобы обеспечить качественные результаты, мы предлагаем сосредоточиться на трех самых мощных моделях на рынке: ChatGPT, Bing Copilot и Google Gemini.

Комментарии закрыты.