Секреты телефона, необходимые энтузиастам искусственного интеллекта: максимально эффективное использование Gemini и ChatGPT

Одной из самых заметных (и, честно говоря, самых скучных) тенденций в индустрии смартфонов за последние два года стали постоянные разговоры об искусственном интеллекте. В частности, компании, занимающиеся производством кремниевых чипов, часто хвастаются тем, что их новейшие мобильные процессоры позволят выполнять операции искусственного интеллекта на устройствах, например, создавать видео.

Мы уже там, хотя и не полностью. На фоне всей шумихи вокруг трюков искусственного интеллекта, которые то удачно, то неудачно реализуются пользователями смартфонов, обсуждение редко выходит за рамки ярких презентаций новых процессоров и постоянно совершенствующихся чат-ботов.

Только когда отсутствие Gemini Nano в Google Pixel 8 вызвало удивление, общественность узнала о критической важности объема оперативной памяти для ИИ на мобильных устройствах. Apple также быстро дала понять, что Apple Intelligence останется доступным только для устройств с объемом оперативной памяти не менее 8 ГБ. Это решение отражает важность оперативной памяти для эффективной работы моделей ИИ.

Но образ «телефона с искусственным интеллектом» — это не только объем памяти. То, насколько хорошо ваш телефон выполняет задачи, связанные с искусственным интеллектом, также зависит от скрытых оптимизаций оперативной памяти и хранилища. И нет, я говорю не только о вместимости.

Инновации в области памяти появятся в телефонах с искусственным интеллектом.

Журнал Digital Trends провел встречу с компанией Micron, мировым лидером в области решений для памяти и хранения данных, чтобы проанализировать роль оперативной памяти и хранилища в работе искусственного интеллекта на смартфонах. Достижения Micron обязательно должны оказаться в центре вашего внимания, когда вы в следующий раз будете покупать телефон премиум-класса.

Новейшие продукты компании из Айдахо включают мобильное хранилище G9 NAND UFS 4.1 и модули оперативной памяти 1γ (1-гамма) LPDDR5X для флагманских смартфонов. Итак, как эти решения в области памяти способствуют развитию ИИ на смартфонах, помимо увеличения емкости?

Начнем с решения для хранения данных NAND UFS 9 в G4.1. Главные обещания — экономичное энергопотребление, сокращение задержек и высокая пропускная способность.. Стандарт UFS 4.1 может достигать пиковой скорости последовательного чтения и записи 4100 МБ/с, что на 15% больше, чем у поколения UFS 4.0, а также снижает показатели задержки.

Еще одним важным преимуществом является то, что портативные устройства хранения данных Micron нового поколения доступны в вариантах емкостью до 2 ТБ. Более того, Micron удалось уменьшить его размер, что сделало его идеальным решением для складных телефонов и тонких телефонов следующего поколения, таких как Samsung Galaxy Край S25.

Переходя к усовершенствованиям оперативной памяти, компания Micron разработала так называемые модули оперативной памяти 1γ LPDDR5X. Он обеспечивает максимальную скорость 9200 МТ/с, может вмещать на 30% больше транзисторов за счет уменьшенных размеров и при этом потребляет на 20% меньше энергии. Компания Micron уже представила немного более медленное решение оперативной памяти 1β (1-beta), которое используется в смартфонах серии Samsung Galaxy S25.

Взаимодействие между хранилищем и искусственным интеллектом

Бен Ривера, директор по маркетингу продуктов подразделения мобильного бизнеса компании Micron, пояснил, что компания Micron внедрила четыре ключевых усовершенствования в свои новейшие решения для хранения данных, чтобы обеспечить более быструю работу ИИ на мобильных устройствах. К этим улучшениям относятся зонированная UFS, дефрагментация данных, закрепленная функция WriteBooster и интеллектуальный отслеживатель задержек.

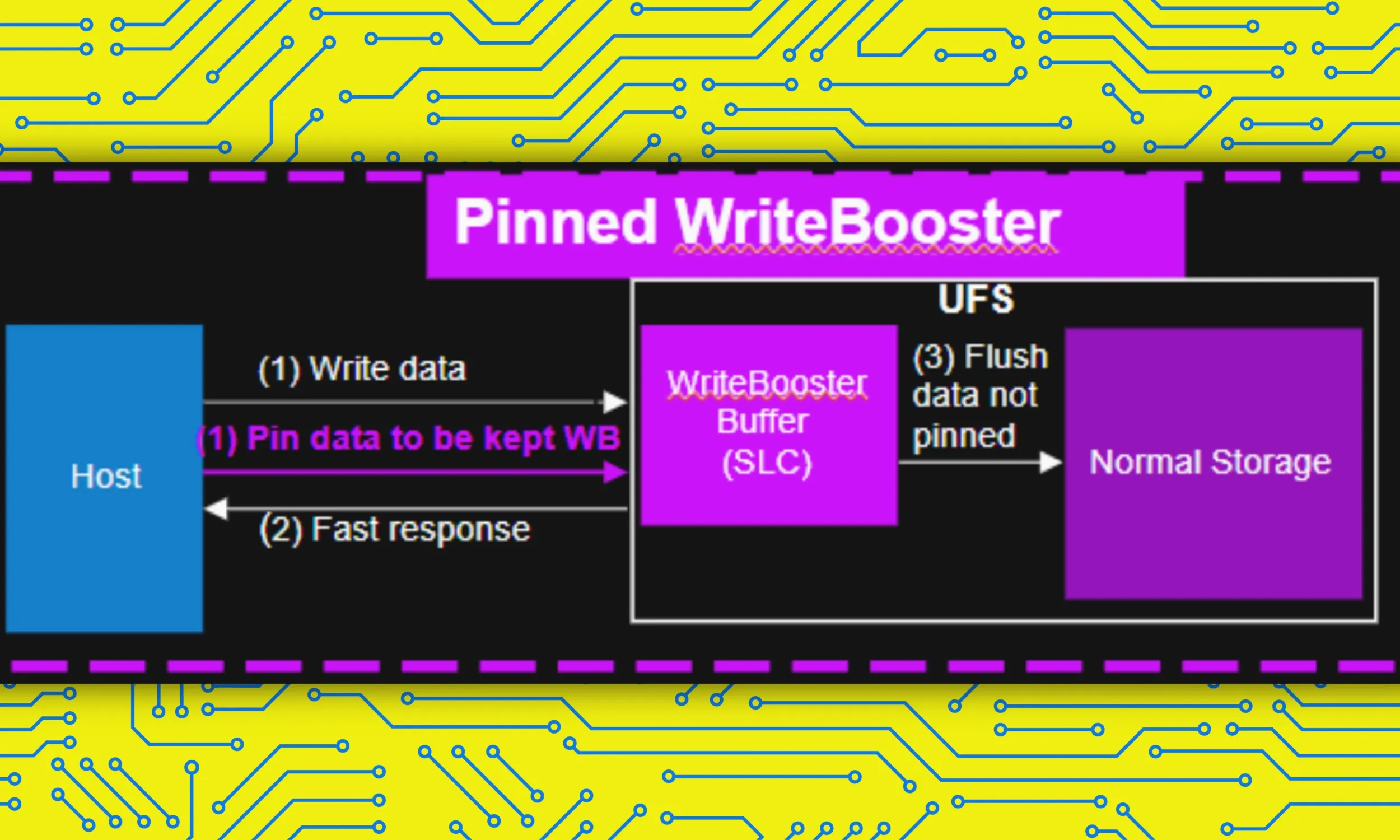

«Эта функция позволяет процессору или хосту идентифицировать и изолировать или «закрепить» наиболее часто используемые данные на смартфоне в области запоминающего устройства, называемой буфером WriteBooster (похожей на кэш), чтобы обеспечить быстрый и немедленный доступ к ним», — объясняет Ривера о функции Pinned WriteBooster.

Каждая модель ИИ, например Google Gemini или ChatGPT, которая стремится выполнять задачи на устройстве, нуждается в собственном наборе файлов инструкций, хранящихся локально на мобильном устройстве. Например, вам нужно Apple Intelligence до 7 ГБ дискового пространства Для всех его операций.

Для выполнения задачи вы не можете делегировать весь стек ИИ оперативной памяти, поскольку ему потребуется место для обработки других важных задач, таких как совершение звонков или взаимодействие с другими важными приложениями. Для устранения ограничений хранилища Micron создается карта памяти, которая загружает из хранилища в оперативную память только требуемые веса ИИ.

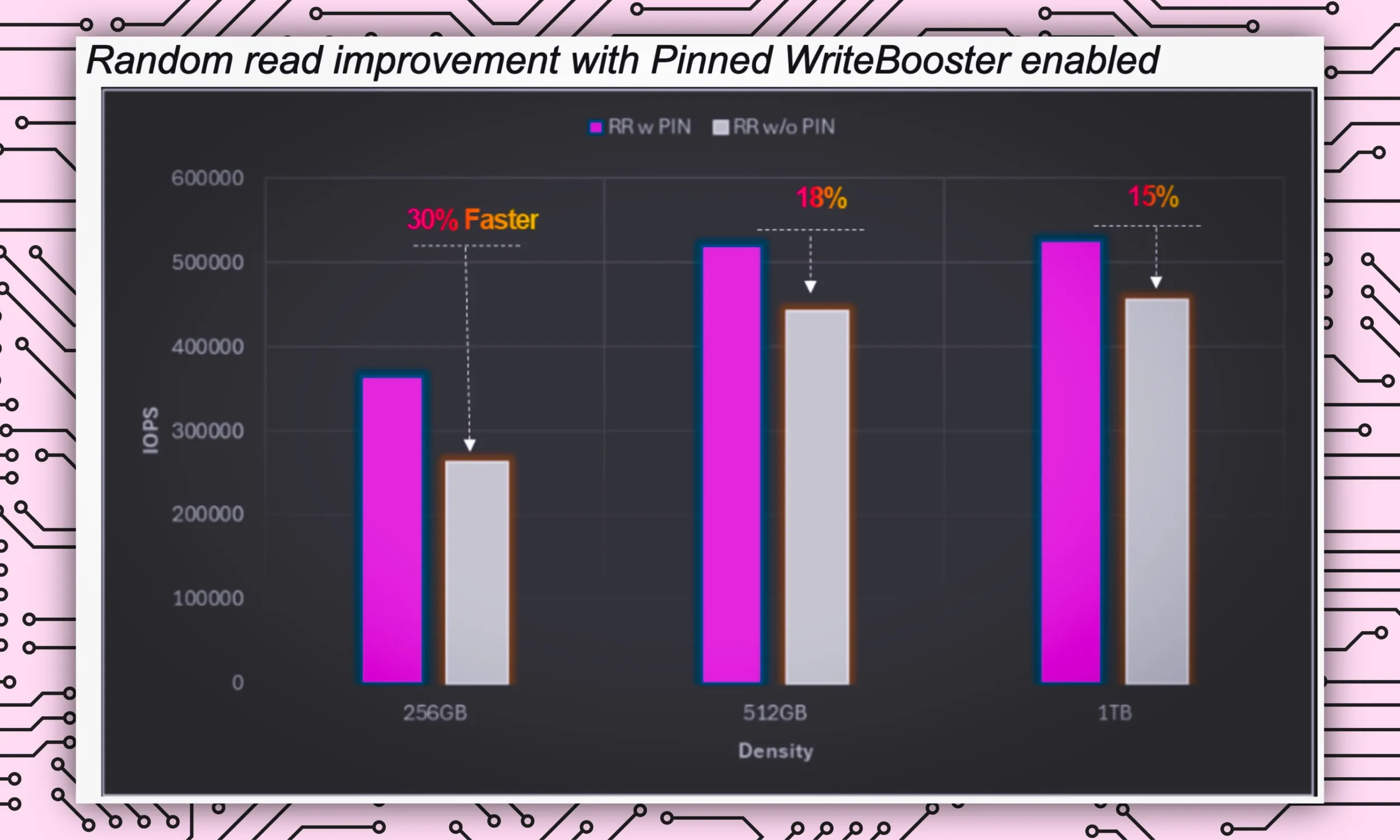

Когда ресурсы становятся ограниченными, вам нужна более быстрая передача и чтение данных. Это гарантирует, что задачи ИИ будут выполнены без снижения скорости выполнения других важных задач. Благодаря Pinned WriteBooster этот обмен данными ускоряется на 30%, гарантируя, что задачи ИИ будут обрабатываться без каких-либо задержек.

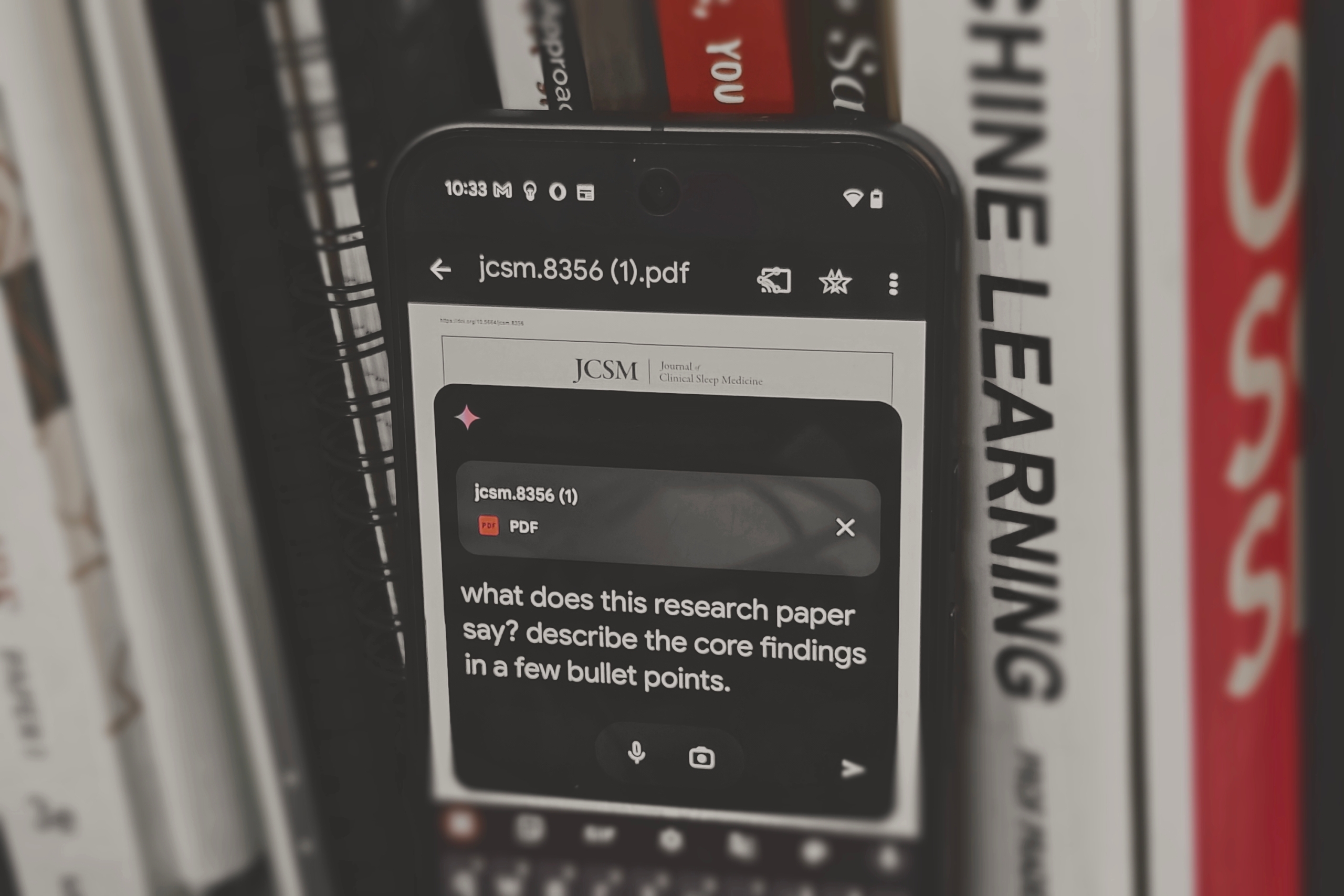

Предположим, вам нужно Gemini извлечет PDF-файл для анализа. Быстрая подкачка памяти обеспечивает быструю передачу необходимых весов ИИ из хранилища в оперативную память.

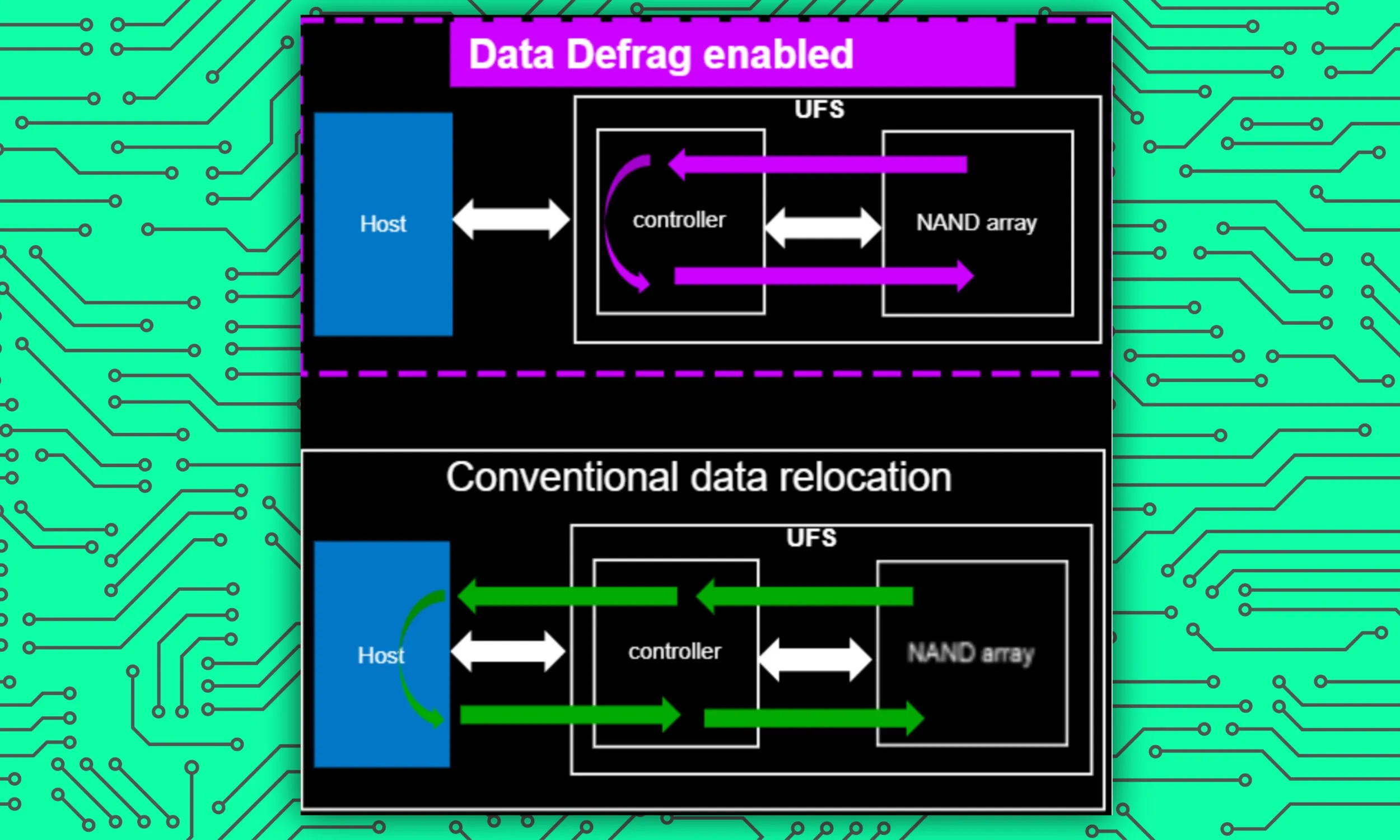

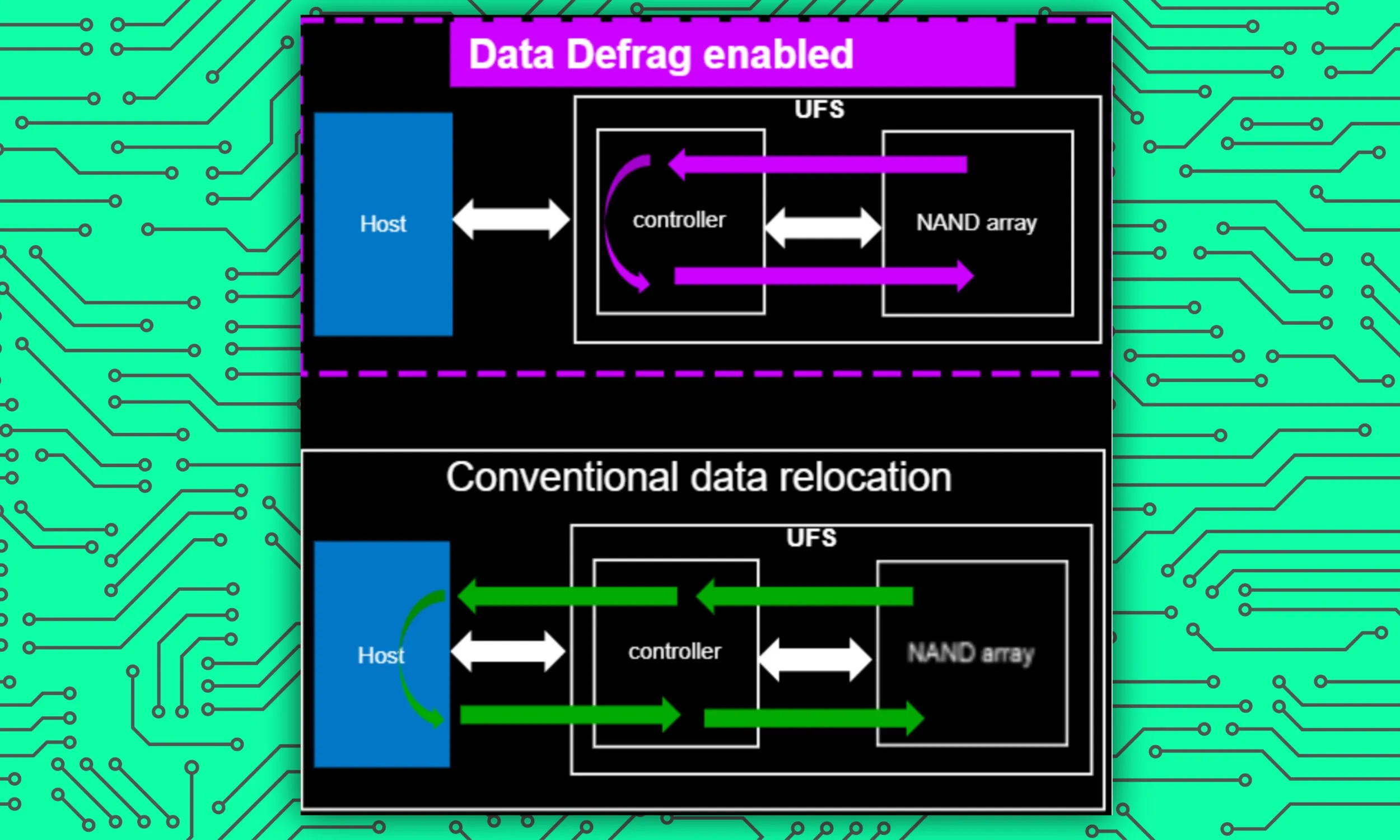

Далее у нас идет дефрагментация данных. Представьте себе органайзер для стола или шкафа, который позволяет аккуратно сгруппировать предметы по разным категориям и разместить их в отдельных шкафах, чтобы их было легко найти.

В случае смартфонов, хотя в течение длительного времени сохраняется большой объём данных, это происходит, как правило, в несколько хаотичном порядке. В результате, когда бортовой системе требуется доступ к определённому типу файлов, найти их все становится сложнее, что приводит к замедлению работы.

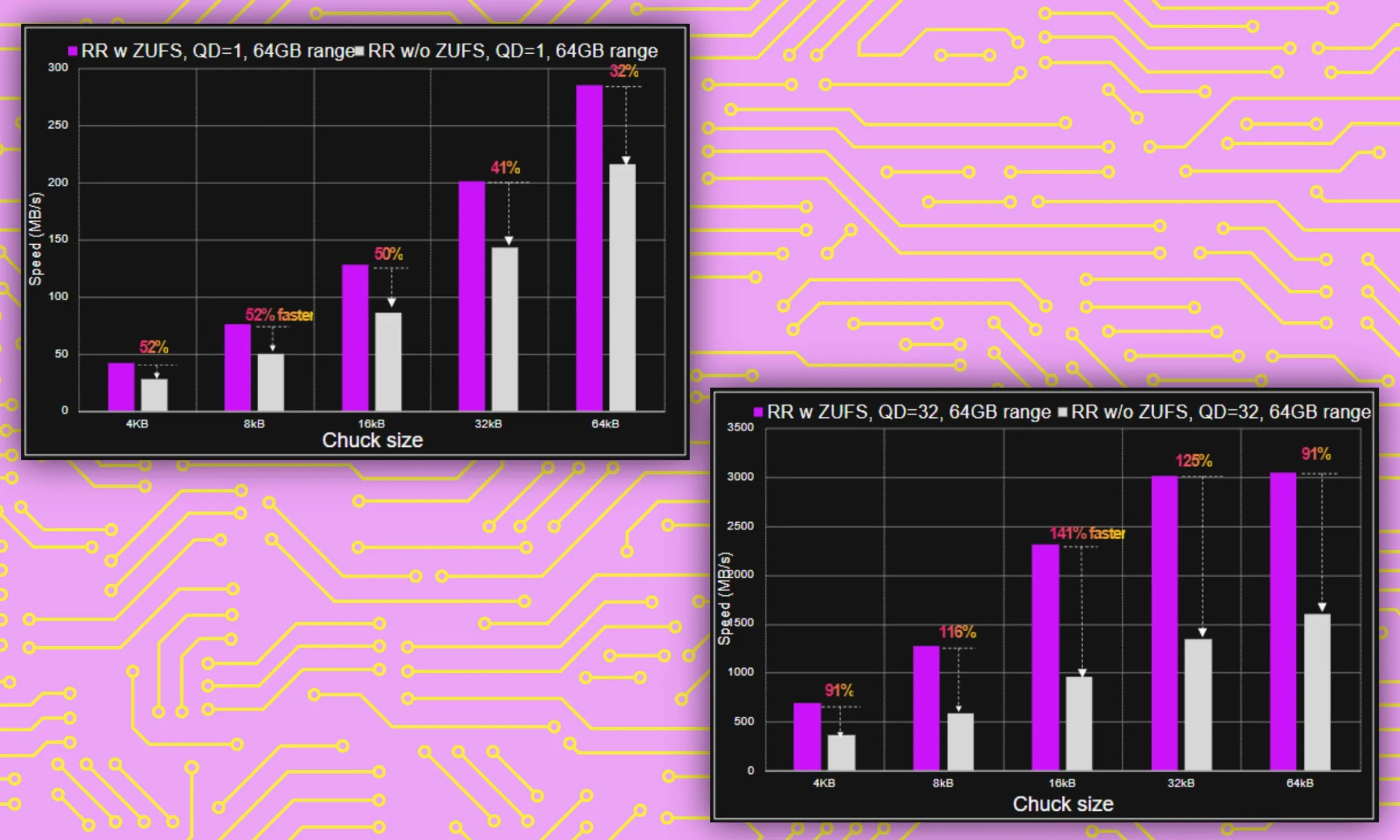

По словам Риверы, Data Defrag не только помогает организовать хранение данных, но и изменяет способ взаимодействия устройства хранения с контроллером устройства. Таким образом, это Увеличивает скорость чтения данных на невероятные 60%, естественным образом ускоряя все типы взаимодействия пользователя с устройством, включая задачи ИИ.

«Эта функция может помочь ускорить функции ИИ, например, когда генеративная модель ИИ, например, используемая для генерации изображения из текстовой подсказки, вызывается из хранилища в память, что позволяет быстрее считывать данные из хранилища в память», — рассказал представитель Micron изданию Digital Trends.

Intelligence Latency Tracker — еще одна функция, которая по сути отслеживает события задержки и факторы, которые могут замедлить обычный темп работы вашего телефона. В дальнейшем это помогает исправлять ошибки и повышать производительность телефона, гарантируя, что обычные задачи, а также задачи ИИ, не столкнутся с проблемами скорости.

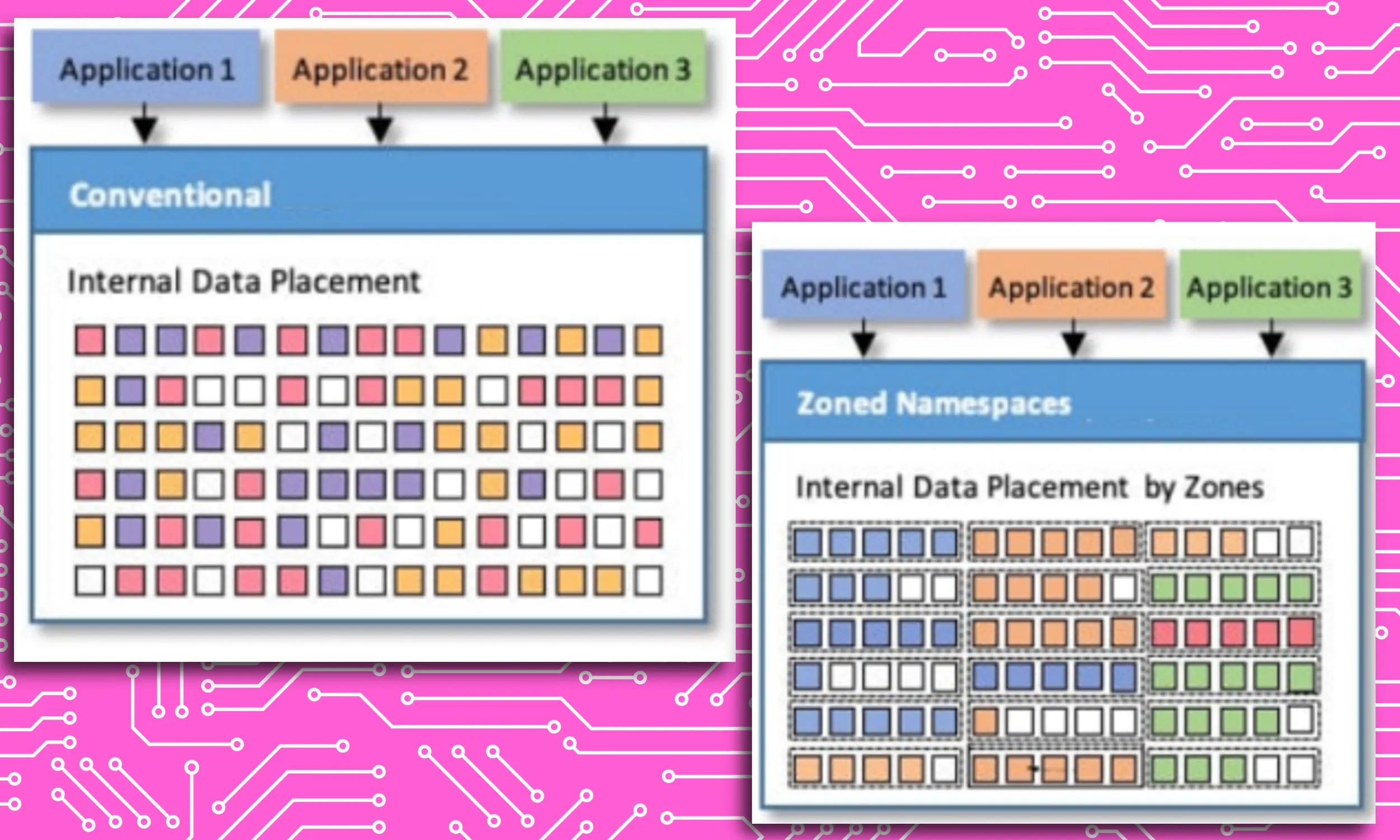

Последнее усовершенствование хранилища — зонированная UFS. Эта система обеспечивает организованное хранение данных со схожим характером ввода/вывода. Это очень важно, поскольку позволяет системе легче находить необходимые файлы, не тратя время на поиск по всем папкам и каталогам.

«Функция ZUFS от Micron помогает организовать данные таким образом, что когда системе требуется найти определенные данные для выполнения задачи, процесс становится более быстрым и плавным», — рассказал нам Ривера.

Переполнение оперативной памяти

Когда речь идет о рабочих процессах ИИ, вам понадобится определенный объем оперативной памяти. Чем больше емкость, тем лучше. В то время как Apple установила базовый объем в 8 ГБ для своего пакета Apple Intelligence, игроки экосистемы Android перешли на 12 ГБ в качестве безопасного значения по умолчанию. почему?

«Использование искусственного интеллекта также требует больших объемов данных и энергии», — объясняет Ривера. «Таким образом, чтобы реализовать потенциал ИИ, память и хранилище должны обеспечивать низкую задержку и высокую производительность при максимальной энергоэффективности».

Благодаря решению нового поколения 5γ (1-гамма) LPDDR1X DRAM для смартфонов компания Micron смогла снизить рабочее напряжение модулей памяти. Затем возникает крайне важный вопрос эффективности на местном уровне. Ривера утверждает, что новые модули памяти могут работать со скоростью до 9.6 гигабит в секунду, обеспечивая выдающуюся производительность искусственного интеллекта.

Компания Micron утверждает, что усовершенствования ее процесса литографии в экстремальном ультрафиолете (EUV) открыли путь не только к более высоким скоростям, но и к значительному повышению энергоэффективности на 20%.

Путь к более персонализированному опыту использования ИИ?

Решения Micron в области оперативной памяти и хранения данных нового поколения для смартфонов нацелены не только на повышение производительности искусственного интеллекта, но и на общее ускорение выполнения повседневных задач на смартфоне. Мне было интересно, ускорит ли улучшенное мобильное хранилище NAND UFS 9 и оперативная память 4.1γ (1-гамма) LPDDR1X процессоры автономного ИИ.

Производители смартфонов, а также лаборатории искусственного интеллекта все чаще переходят на локальную обработку данных с использованием искусственного интеллекта. Это означает, что вместо отправки ваших запросов на облачный сервер, где процесс обрабатывается, а затем результат отправляется на ваш телефон с помощью интернет-соединения, весь рабочий процесс выполняется локально на вашем телефоне.

От расшифровки звонков и голосовых заметок до преобразования сложных исследовательских материалов в PDF-файлы — все происходит на вашем телефоне, и никакие личные данные не покидают ваше устройство. Это более безопасный и быстрый подход, но в то же время он требует мощных системных ресурсов. Одним из таких важных требований является более быстрый и эффективный модуль памяти.

Могут ли решения Micron следующего поколения помочь решить проблему ИИ на локальном уровне? Она может. Фактически, это также ускорит процессы, требующие подключения к облаку, такие как создание видеороликов с использованием модели Veo от Google, для которой по-прежнему требуются мощные вычислительные серверы.

«Нативное ИИ-приложение, работающее непосредственно на устройстве, будет иметь наибольший трафик, поскольку оно не только считывает пользовательские данные с устройства хранения, но и выполняет ИИ-вывод на устройстве», — говорит Ривера. «В этом случае наши функции помогут оптимизировать поток данных для обоих».

Итак, когда же можно ожидать появления на полках телефонов на базе новейших решений Micron? Ривера утверждает, что все основные производители смартфонов перейдут на модули оперативной памяти и хранения данных Micron следующего поколения. С точки зрения доступа на рынок, «основные модели, запуск которых запланирован на конец 2025 или начало 2026 года» должны быть в вашем списке покупок.

Комментарии закрыты.